볼류메트릭 비디오 저작 연구 보고 넥슨코리아 데브캣 스튜디오 파이오니어랩 김주복 2017.08.28

A presentation at 넥슨 데브캣 스튜디오 내부 강연 in August 2017 in Bundang-gu, Seongnam-si, Gyeonggi-do, South Korea by Jubok Kim

볼류메트릭 비디오 저작 연구 보고 넥슨코리아 데브캣 스튜디오 파이오니어랩 김주복 2017.08.28

아젠다 볼류메트릭 비디오란 무엇인가? 어떻게 만들면 되나? 연구 진행 경과 개요 0. 탐색 1. 프로토타이핑 2. 고품질 캡처 3-a. 연속 비강체 정합을 통한 고품질 캡처 3-b. 수퍼 해상도를 활용한 고품질 캡처 3-c. TSDF 퓨전을 활용한 고품질 캡처 결론 및 추후 과제 레퍼런스

볼류메트릭 비디오란 무엇인가? 그리고 이 연구를 통해서 무엇을 얻고자 하는가?

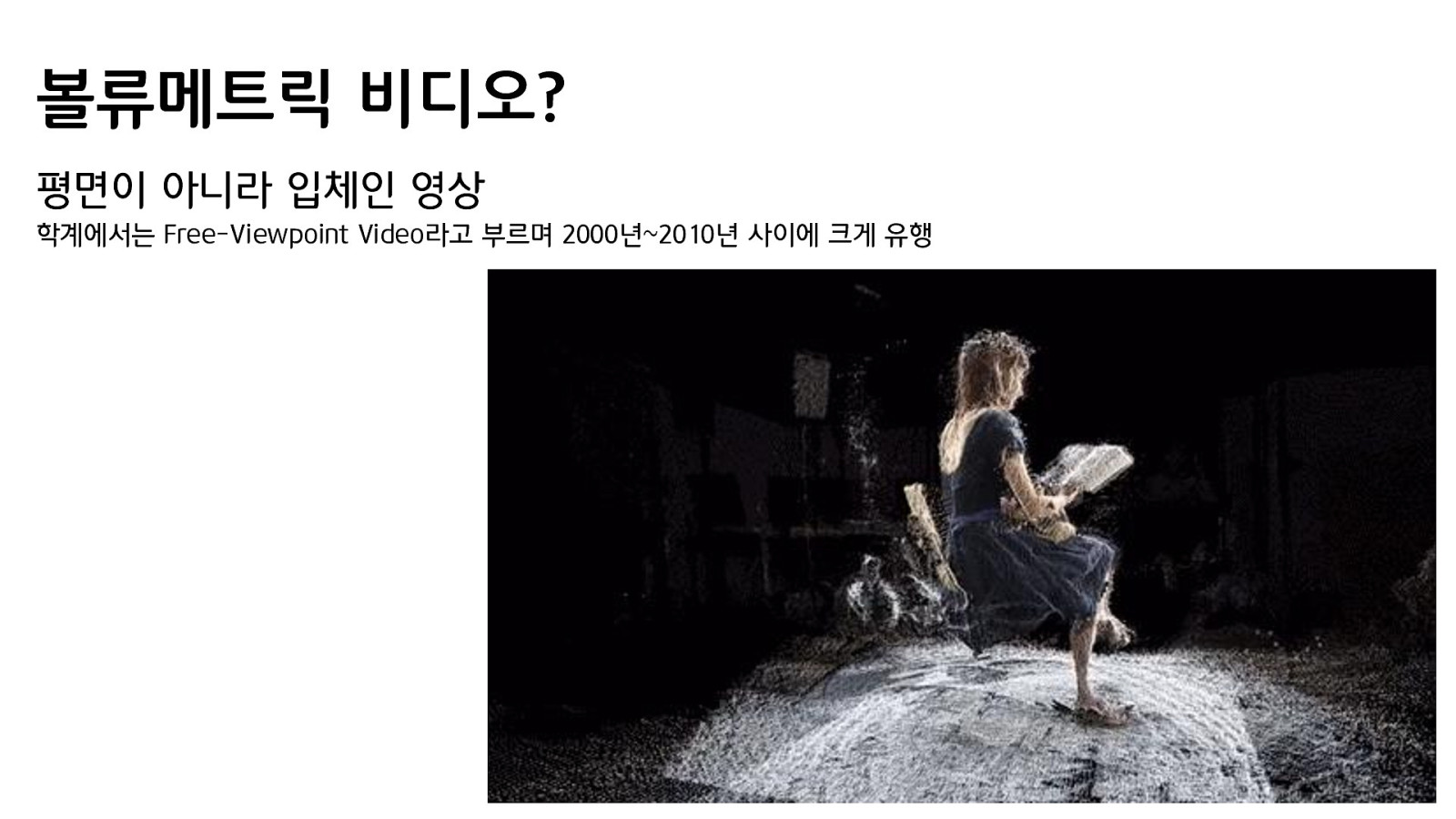

볼류메트릭 비디오? 평면이 아니라 입체인 영상 학계에서는 Free-Viewpoint Video라고 부르며 2000년~2010년 사이에 크게 유행

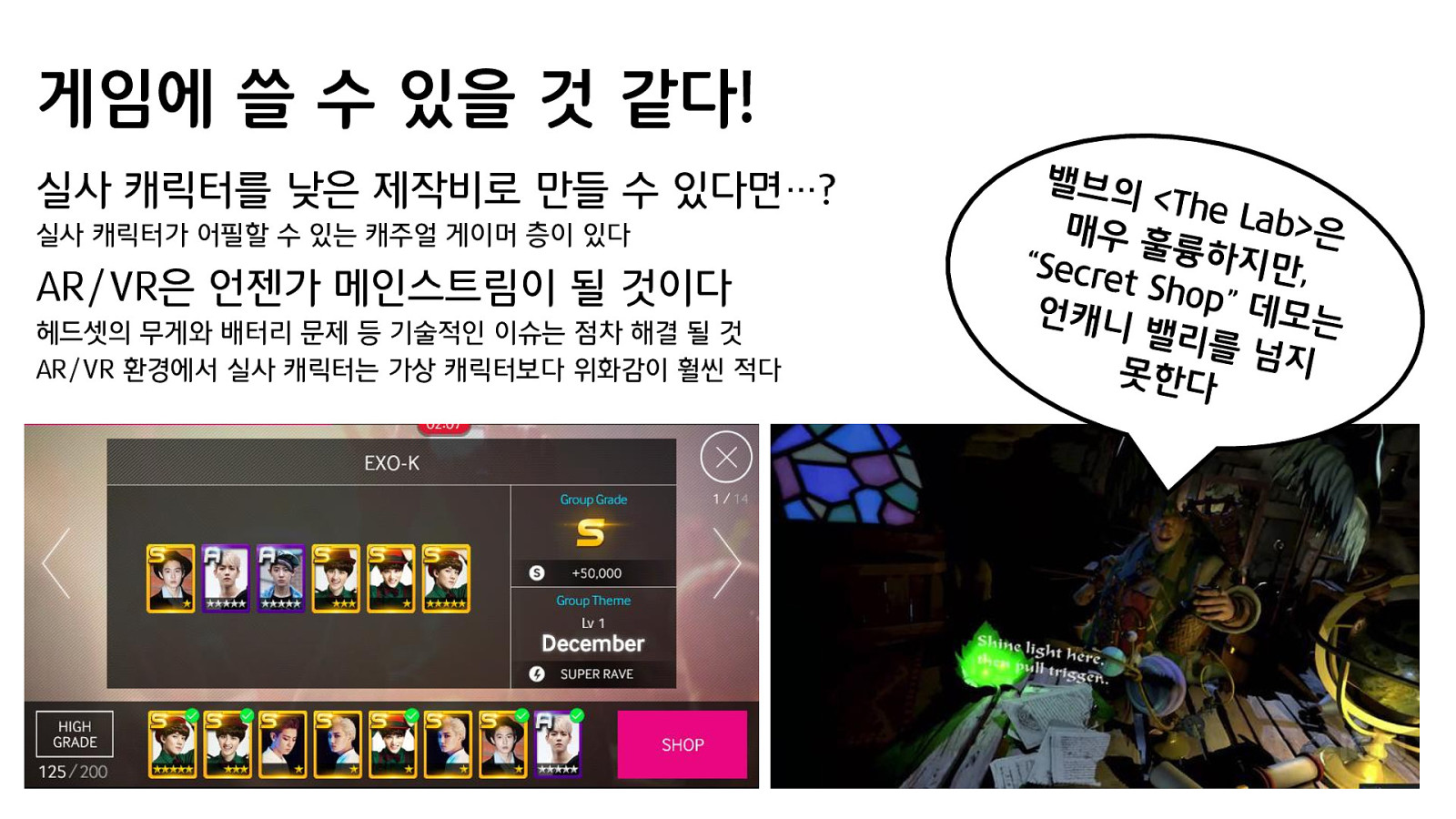

게임에 쓸 수 있을 것 같다! 실사 캐릭터를 낮은 제작비로 만들 수 있다면…? 실사 캐릭터가 어필할 수 있는 캐주얼 게이머 층이 있다 AR/VR은 언젠가 메인스트림이 될 것이다 헤드셋의 무게와 배터리 문제 등 기술적인 이슈는 점차 해결 될 것 AR/VR 환경에서 실사 캐릭터는 가상 캐릭터보다 위화감이 훨씬 적다

하지만 저작이 ‘어렵다’ 스튜디오급의 어마어마한 설비가 필요 뎁스 카메라의 해상도는 대체적으로 매우 낮다 360도 전면을 스캔하려면 전면에 카메라를 설치해야 한다 광량이 부족하면 텍스처를 제대로 스캔할 수 없다 :

좀 더 쉽게 만들 방법을 찾아보자 컨슈머 하드웨어를 활용하면 저작 비용을 낮출 수 있지 않을까? Kinect v2, ZED 등 가격 대 성능비가 높은 제품이 많이 출시 Kinect v1 (2009) 컬러 640×480 뎁스 320×240 Kinect v2 컬러 6.75배 뎁스 2.82배 컬러 1920×1080 뎁스 512×424 (2014)

어떻게 만들면 되나? 조사 단계에서 설정한 연구 방향

키넥트 4대로 사방에서 촬영하면 되는 거 아냐? 처음엔 그렇게 생각했지만… 뎁스 카메라의 해상도가 매우 낮아서 품질이 낮다 (전신 촬영 시 0.475cm/픽셀) 특히 외곽선 주변에서 잘못된 데이터가 들어올 확률이 매우 높다

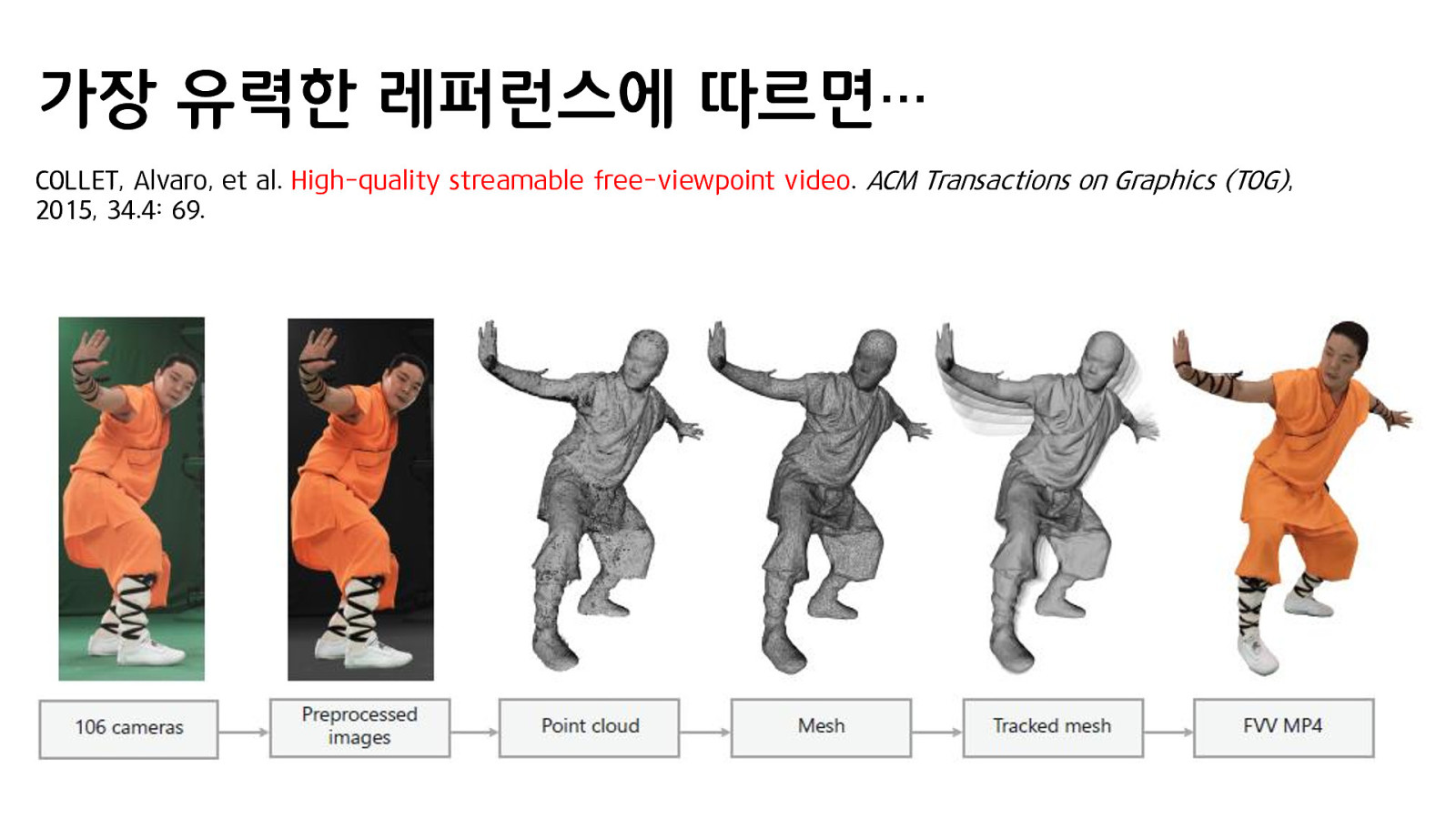

가장 유력한 레퍼런스에 따르면… COLLET, Alvaro, et al. High-quality streamable free-viewpoint video. ACM Transactions on Graphics (TOG), 2015, 34.4: 69.

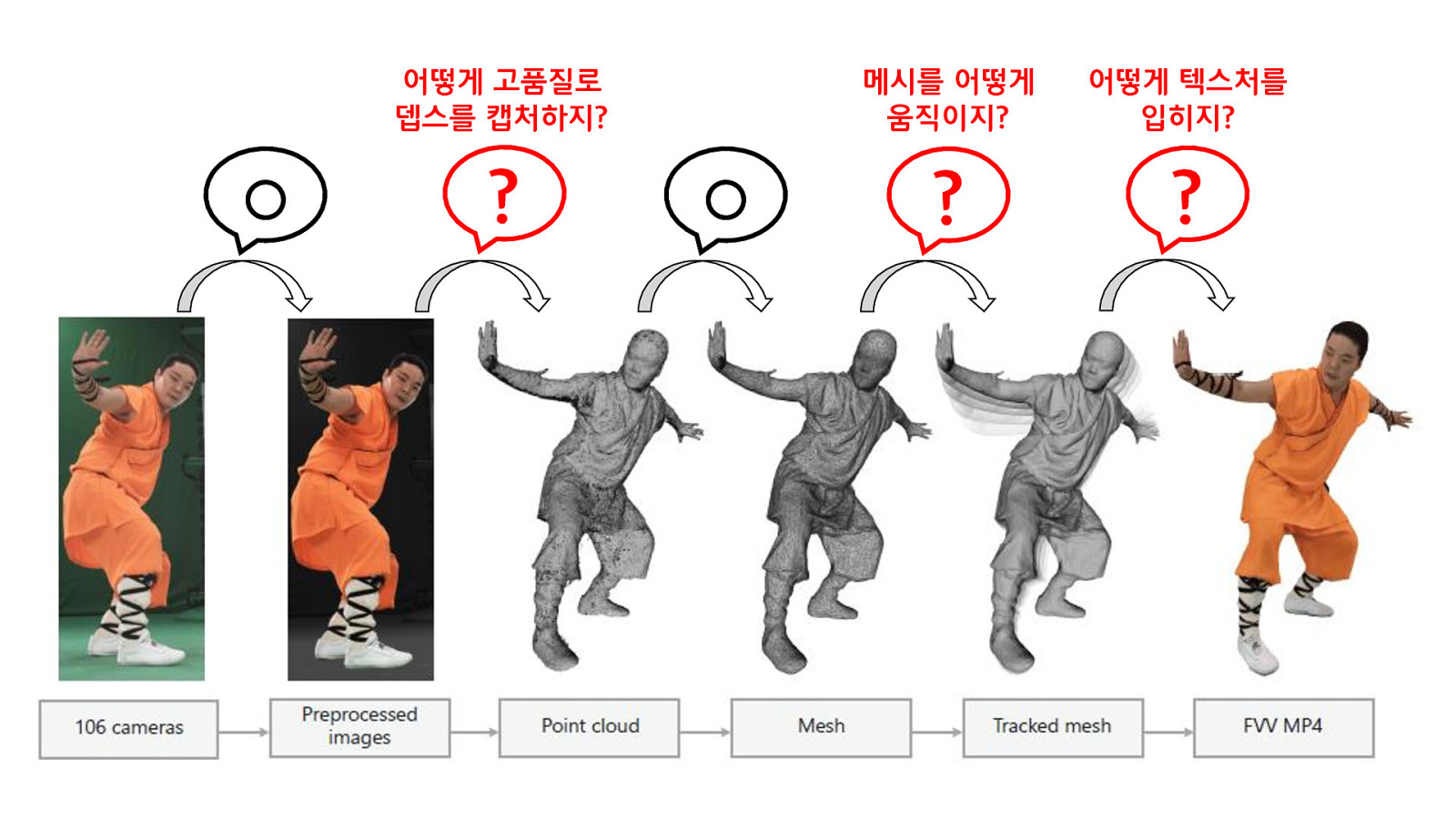

어떻게 고품질로 뎁스를 캡처하지? ○ ? ○ 메시를 어떻게 움직이지? 어떻게 텍스처를 입히지? ? ?

고품질 데이터 = 고가의 설비 합쳐서 106대의 카메라, 정확한 캘리브레이션 캡처된 뎁스를 합치기만 해도 충분한 품질 확보 → 이 연구에서는 다른 방향으로 접근해본다

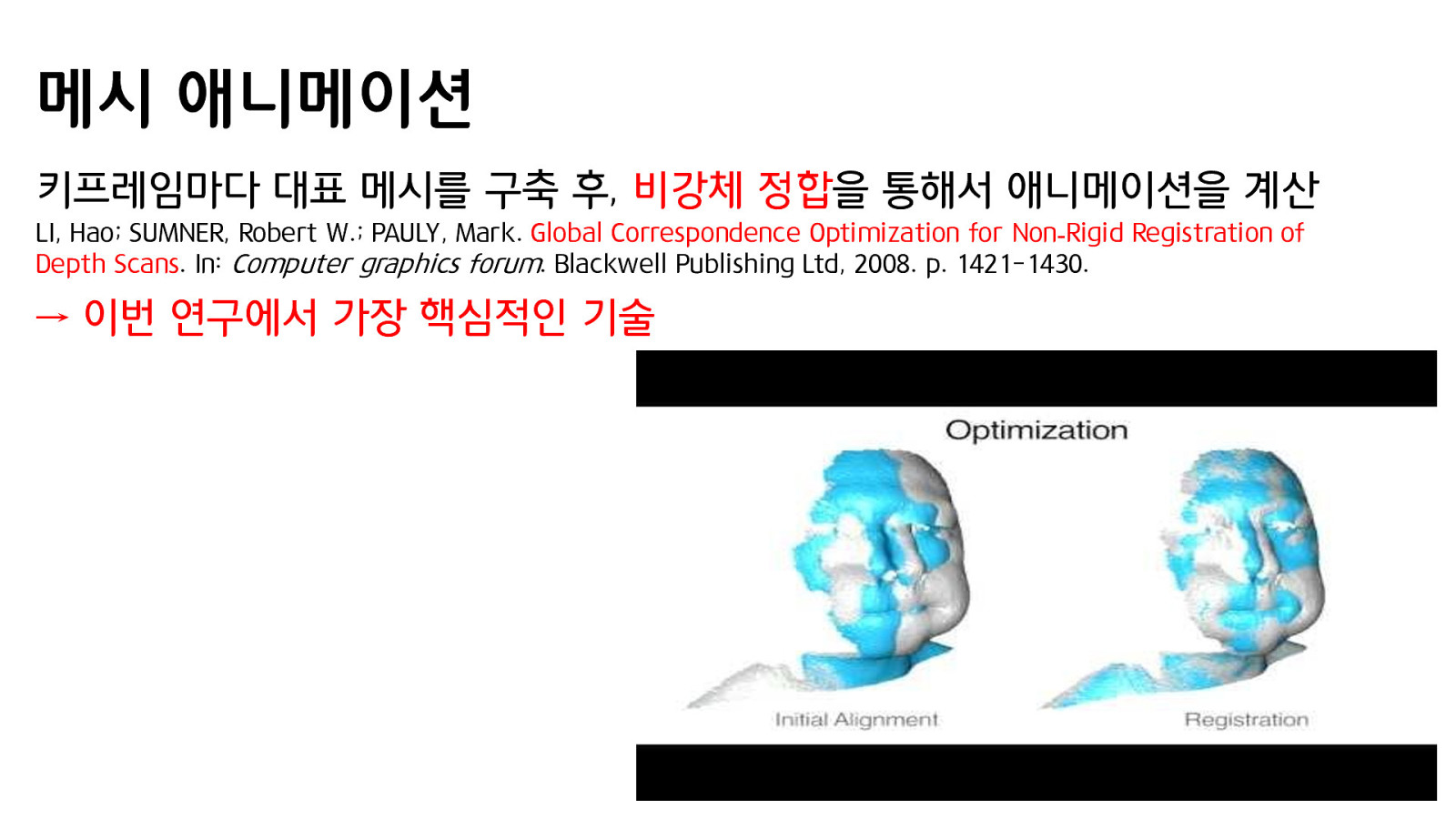

메시 애니메이션 키프레임마다 대표 메시를 구축 후, 비강체 정합을 통해서 애니메이션을 계산 LI, Hao; SUMNER, Robert W.; PAULY, Mark. Global Correspondence Optimization for Non‐Rigid Registration of Depth Scans. In: Computer graphics forum. Blackwell Publishing Ltd, 2008. p. 1421-1430. → 이번 연구에서 가장 핵심적인 기술

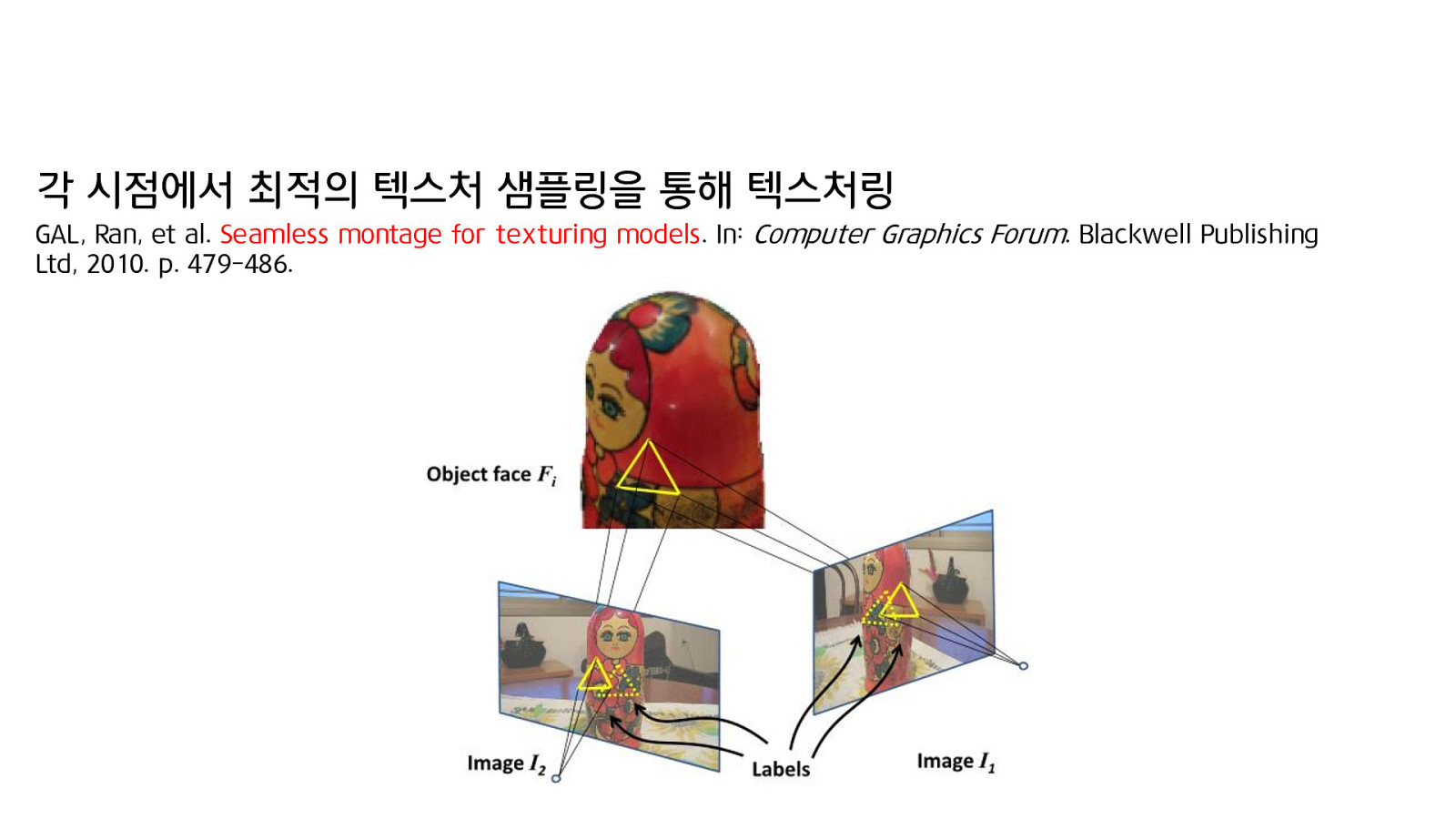

텍스처 캡처 폴리곤마다 가장 잘 보이는 컬러 캡처를 배정한 뒤, 폴리곤 에지마다 옆 폴리곤과 오차가 가장 적도록 계산 GAL, Ran, et al. Seamless montage for texturing models. In: Computer Graphics Forum. Blackwell Publishing Ltd, 2010. p. 479-486.

연구 진행 경과 개요

약 6개월간 진행 (3월~8월) 0. 탐색 3월 7일 3월 8일~3월 15일 연구 착수, 관련 기술 자료 조사 키넥트를 활용한 기본적인 뎁스 캡처와 메시 재구축

3-a. 비강체 정합을 통한 고품질 캡처 5월 16일~5월 17일 5월 18일~6월 16일 6월 17일~7월 6일 연속된 뎁스 비디오에서 고품질 캡처 생성 시도 (1차) WLS 비강체 정합 솔버 개선 시도 (1차) 연속된 뎁스 비디오에서 고품질 메시 재구축 (2차) 3-b. 수퍼 해상도를 활용한 고품질 캡처 7월 6일~8월 1일 8월 2일~8월 8일 뎁스 이미지의 수퍼 해상도 연구 수퍼 해상도 처리된 뎁스 이미지로 고품질 메시 재구축 3-c. TSDF 퓨전을 활용한 고품질 캡처 8월 9일~8월 25일 TSDF 퓨전으로 고품질 메시 재구축

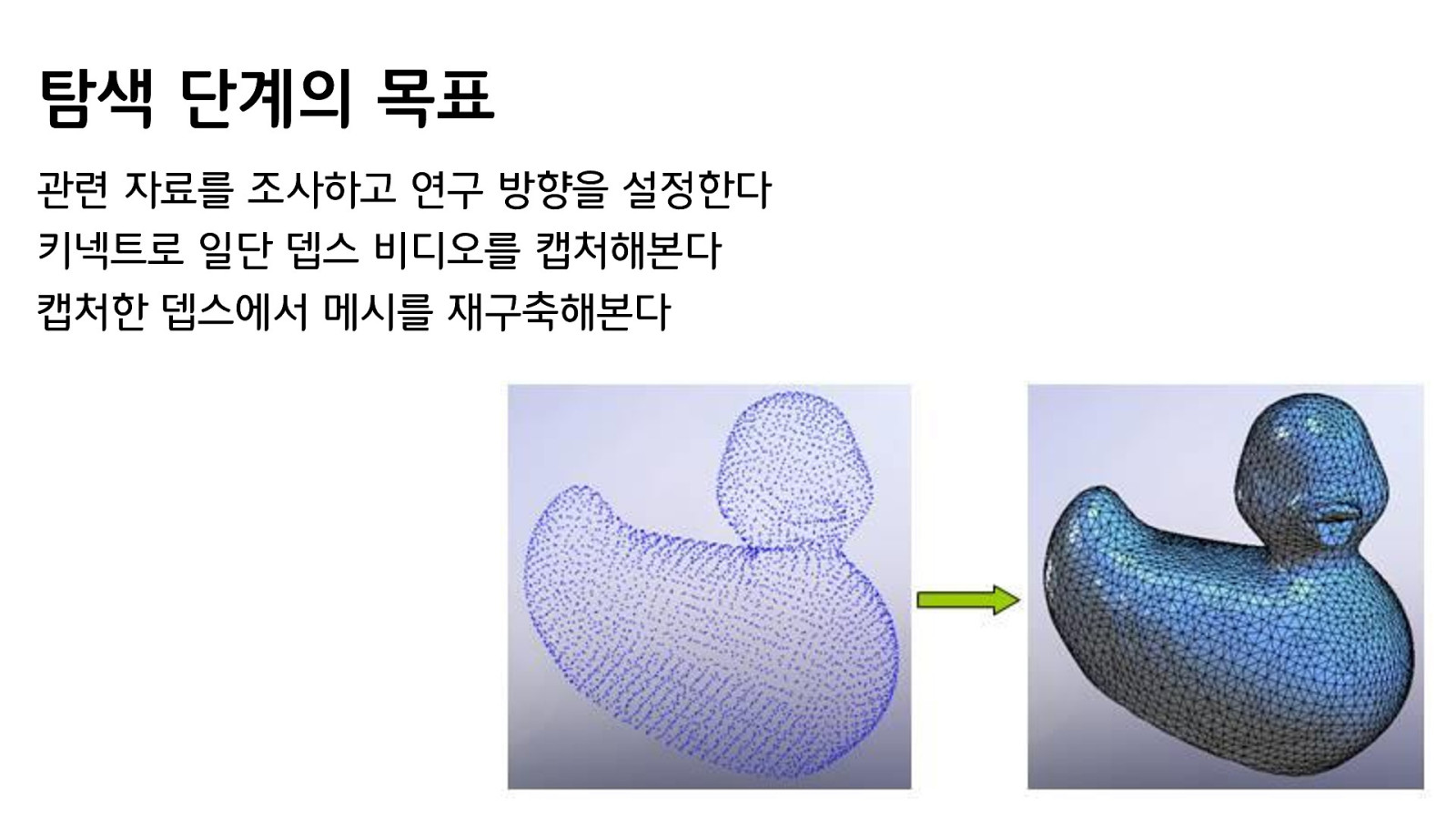

탐색 단계의 목표 관련 자료를 조사하고 연구 방향을 설정한다 키넥트로 일단 뎁스 비디오를 캡처해본다 캡처한 뎁스에서 메시를 재구축해본다

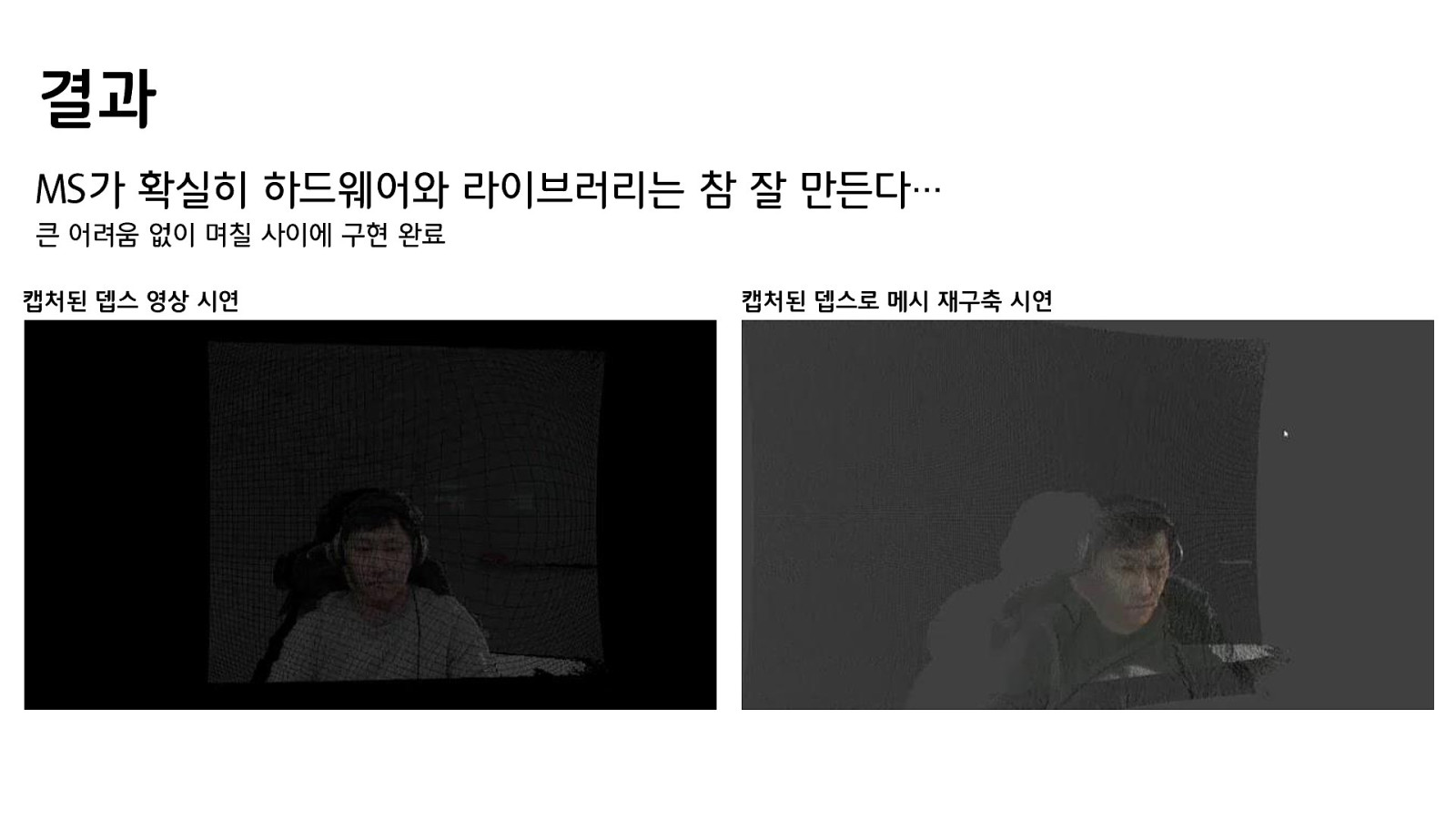

결과 MS가 확실히 하드웨어와 라이브러리는 참 잘 만든다… 큰 어려움 없이 며칠 사이에 구현 완료 캡처된 뎁스 영상 시연 캡처된 뎁스로 메시 재구축 시연

탐색 단계 평가 관련 분야의 전체적인 기술 수준을 확인했다 매우 빠르게 키넥트 활용 테스트를 마쳤다 오픈소스 라이브러리도 꽤 괜찮다 Point Cloud Library로 웬만한 단순 작업은 다 처리할 수 있다 다음 단계 연구 방향을 빠르게 결정했다

프로토타이핑 단계의 목표 일단 품질이 낮더라도 볼류메트릭 비디오를 만들어본다 → 가중 최소 자승 근사를 이용한 비강체 정합을 구현한다 → 정합 결과를 키 프레임 애니메이션으로 변환한다 → 텍스처를 언랩하고, 비디오 텍스처를 베이킹한다

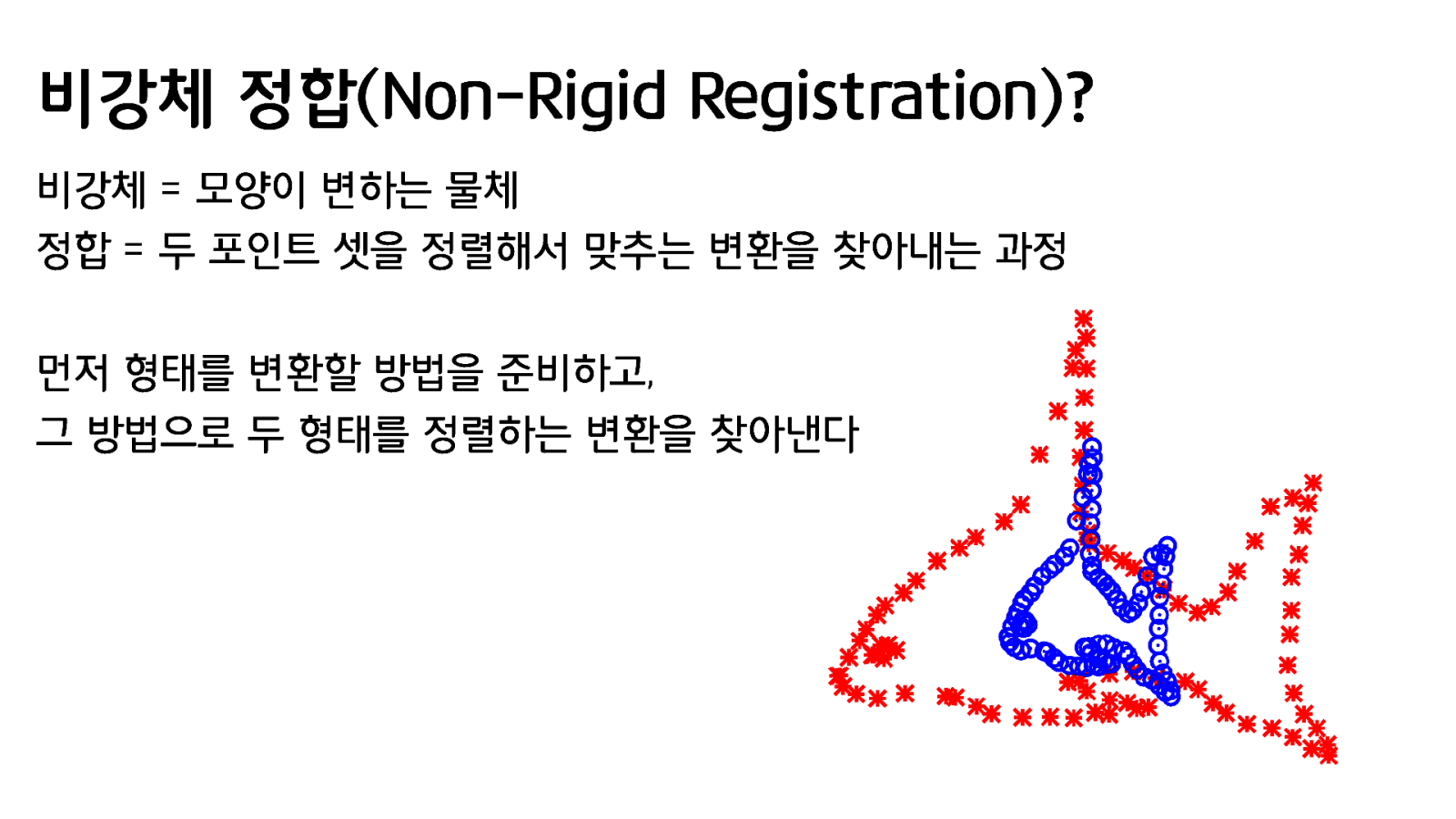

비강체 정합(Non-Rigid Registration)? 비강체 = 모양이 변하는 물체 정합 = 두 포인트 셋을 정렬해서 맞추는 변환을 찾아내는 과정 먼저 형태를 변환할 방법을 준비하고, 그 방법으로 두 형태를 정렬하는 변환을 찾아낸다

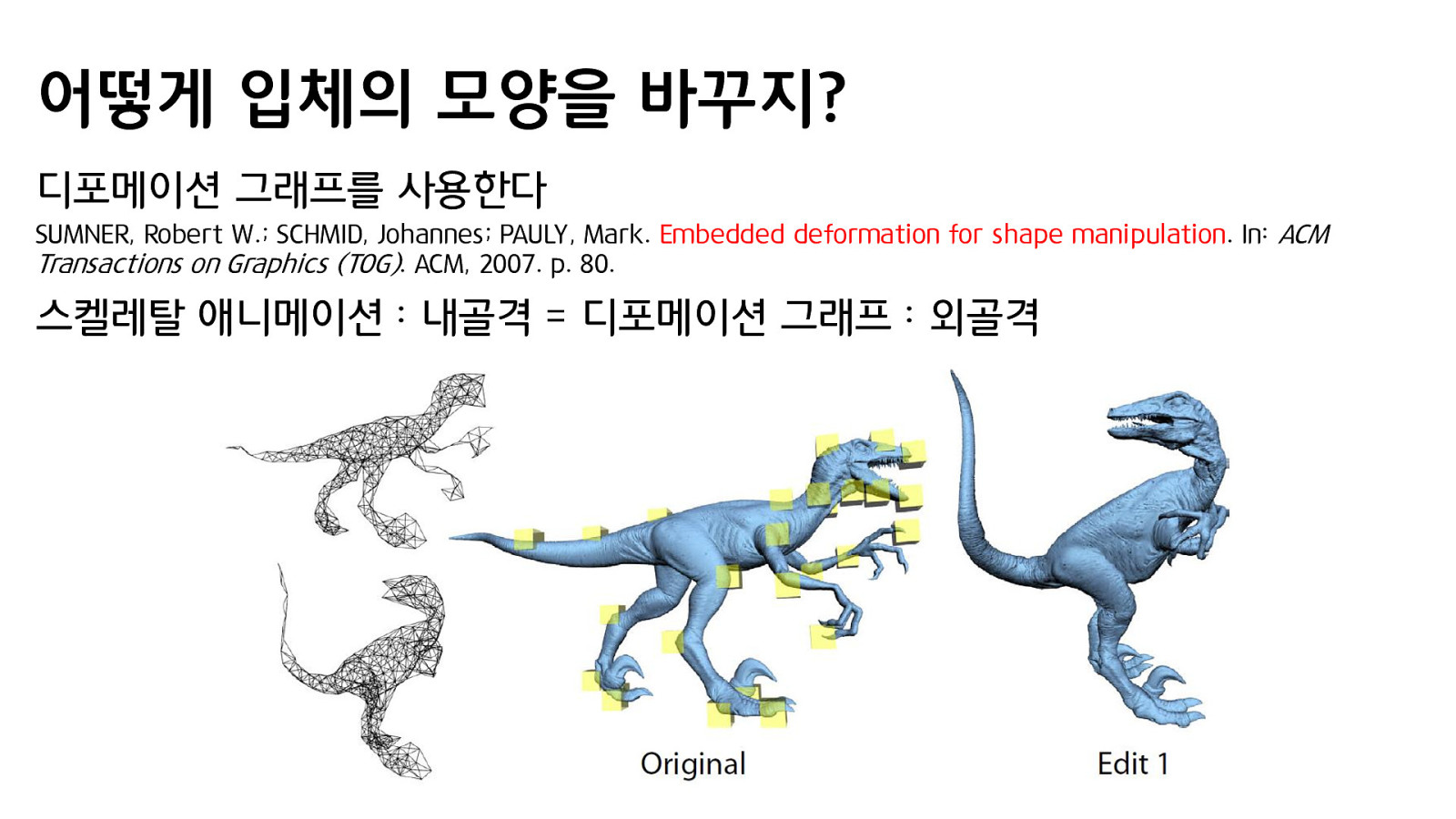

어떻게 입체의 모양을 바꾸지? 디포메이션 그래프를 사용한다 SUMNER, Robert W.; SCHMID, Johannes; PAULY, Mark. Embedded deformation for shape manipulation. In: ACM Transactions on Graphics (TOG). ACM, 2007. p. 80. 스켈레탈 애니메이션 : 내골격 = 디포메이션 그래프 : 외골격

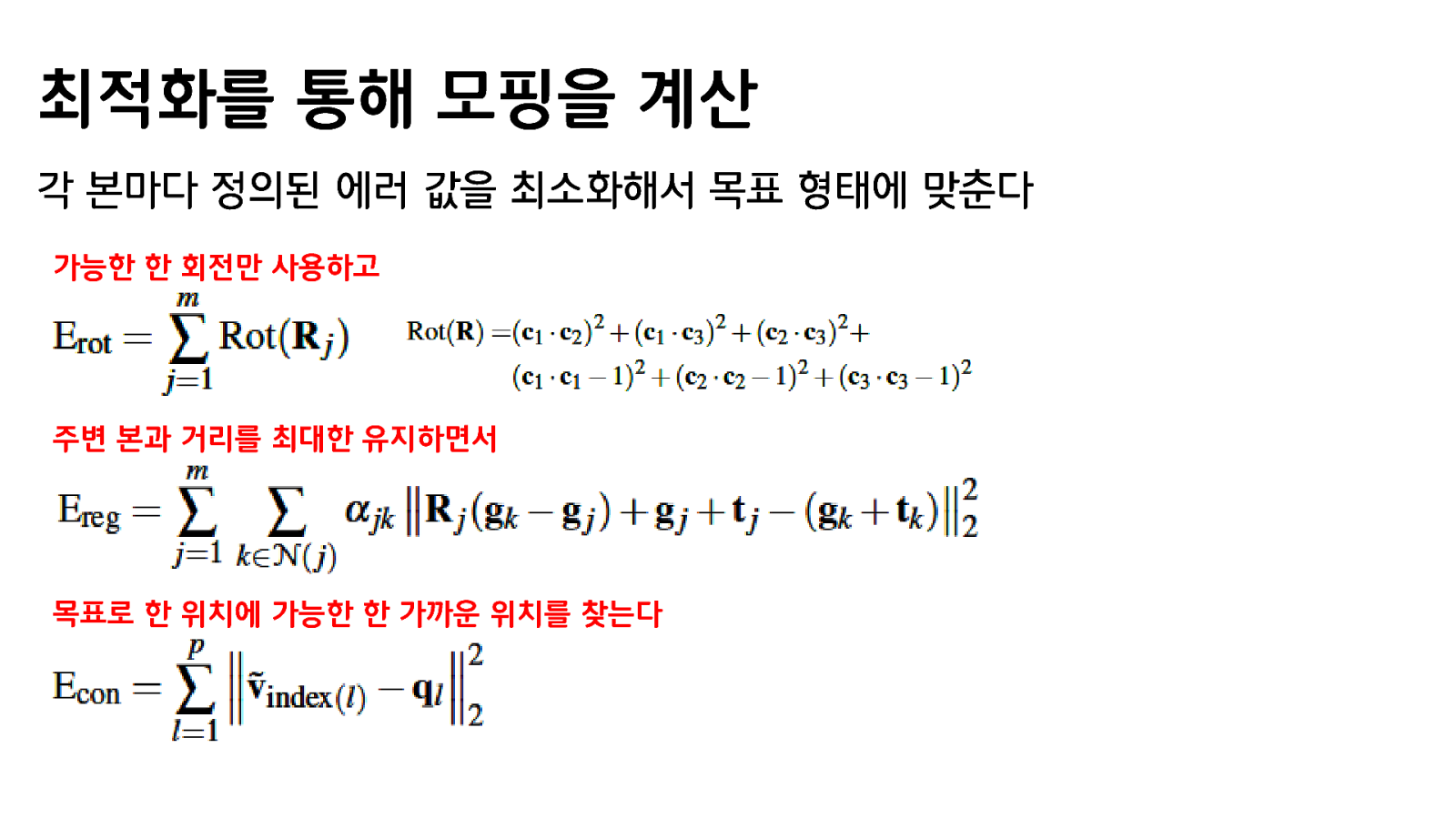

최적화를 통해 모핑을 계산 각 본마다 정의된 에러 값을 최소화해서 목표 형태에 맞춘다 가능한 한 회전만 사용하고 주변 본과 거리를 최대한 유지하면서 목표로 한 위치에 가능한 한 가까운 위치를 찾는다

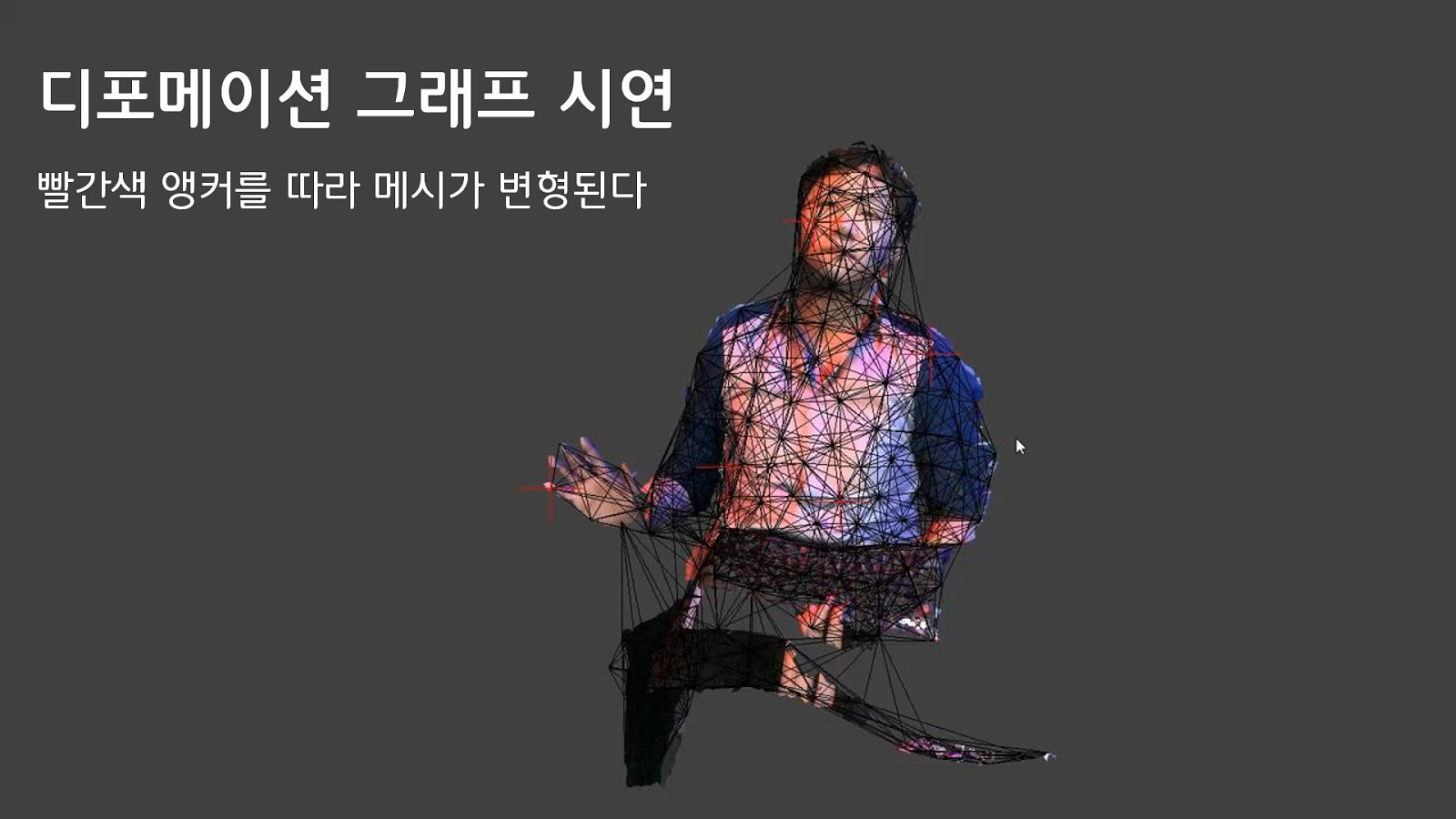

디포메이션 그래프 시연 빨간색 앵커를 따라 메시가 변형된다

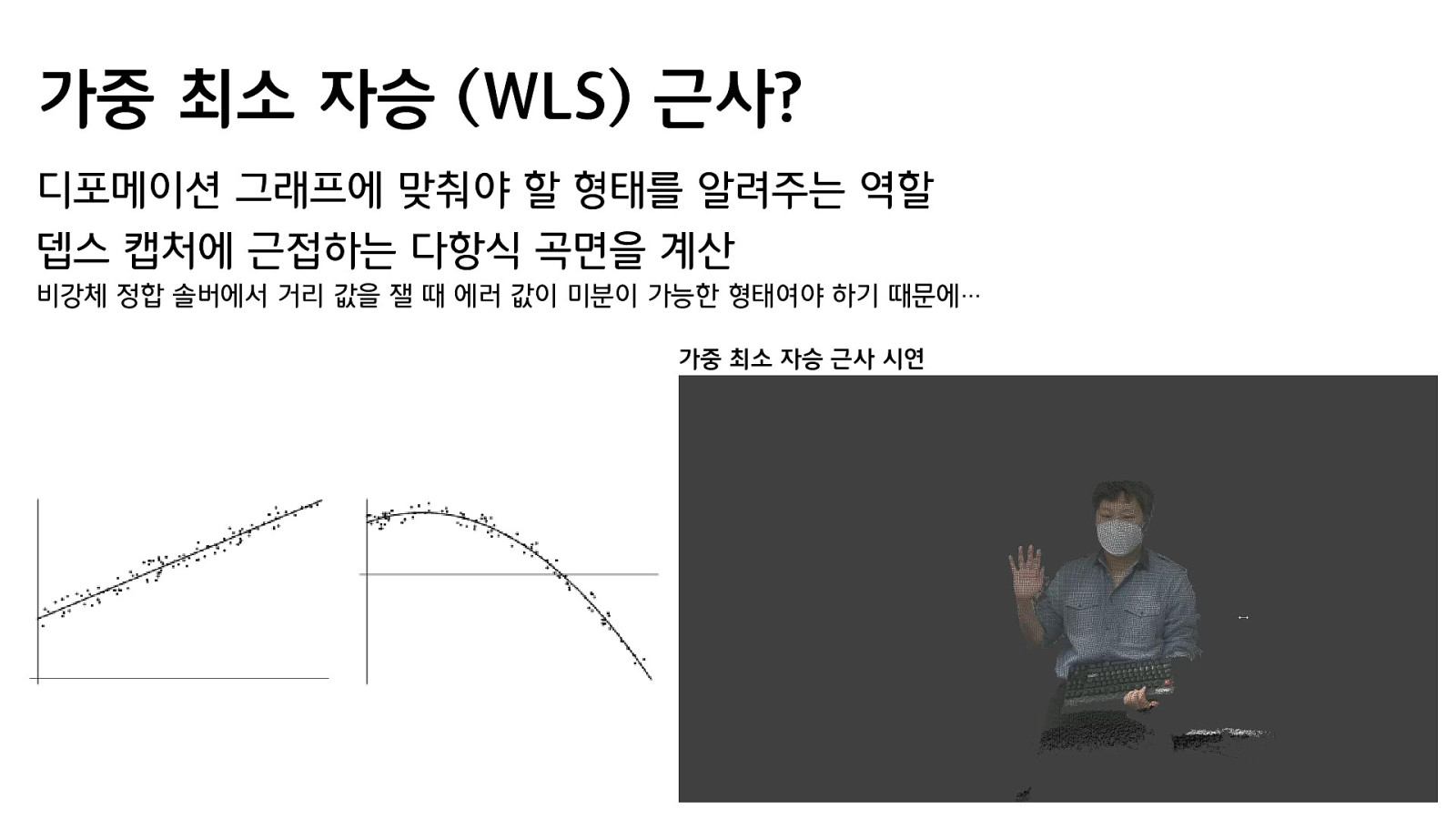

가중 최소 자승 (WLS) 근사? 디포메이션 그래프에 맞춰야 할 형태를 알려주는 역할 뎁스 캡처에 근접하는 다항식 곡면을 계산 비강체 정합 솔버에서 거리 값을 잴 때 에러 값이 미분이 가능한 형태여야 하기 때문에… 가중 최소 자승 근사 시연

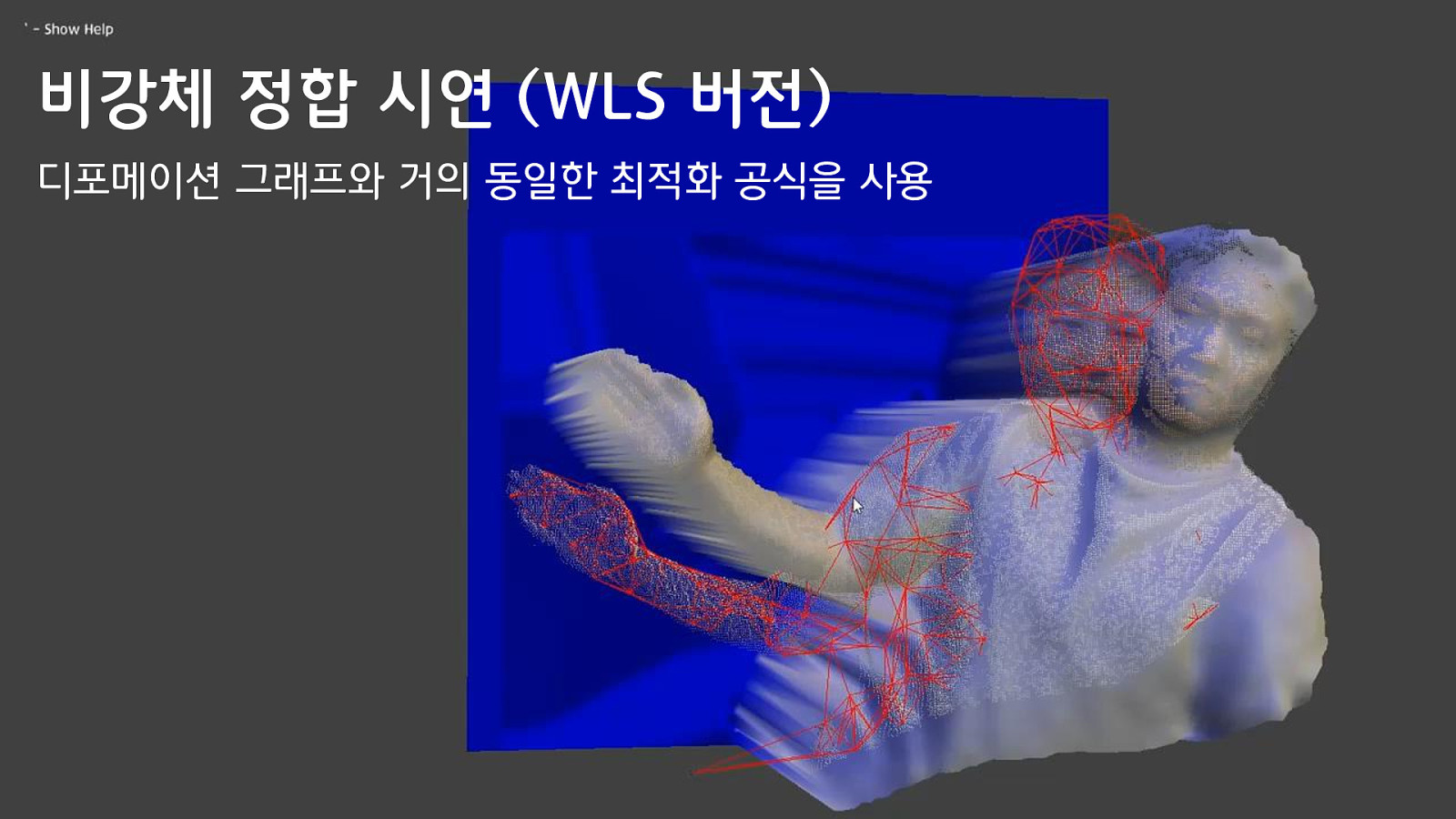

비강체 정합 시연 (WLS 버전) 디포메이션 그래프와 거의 동일한 최적화 공식을 사용

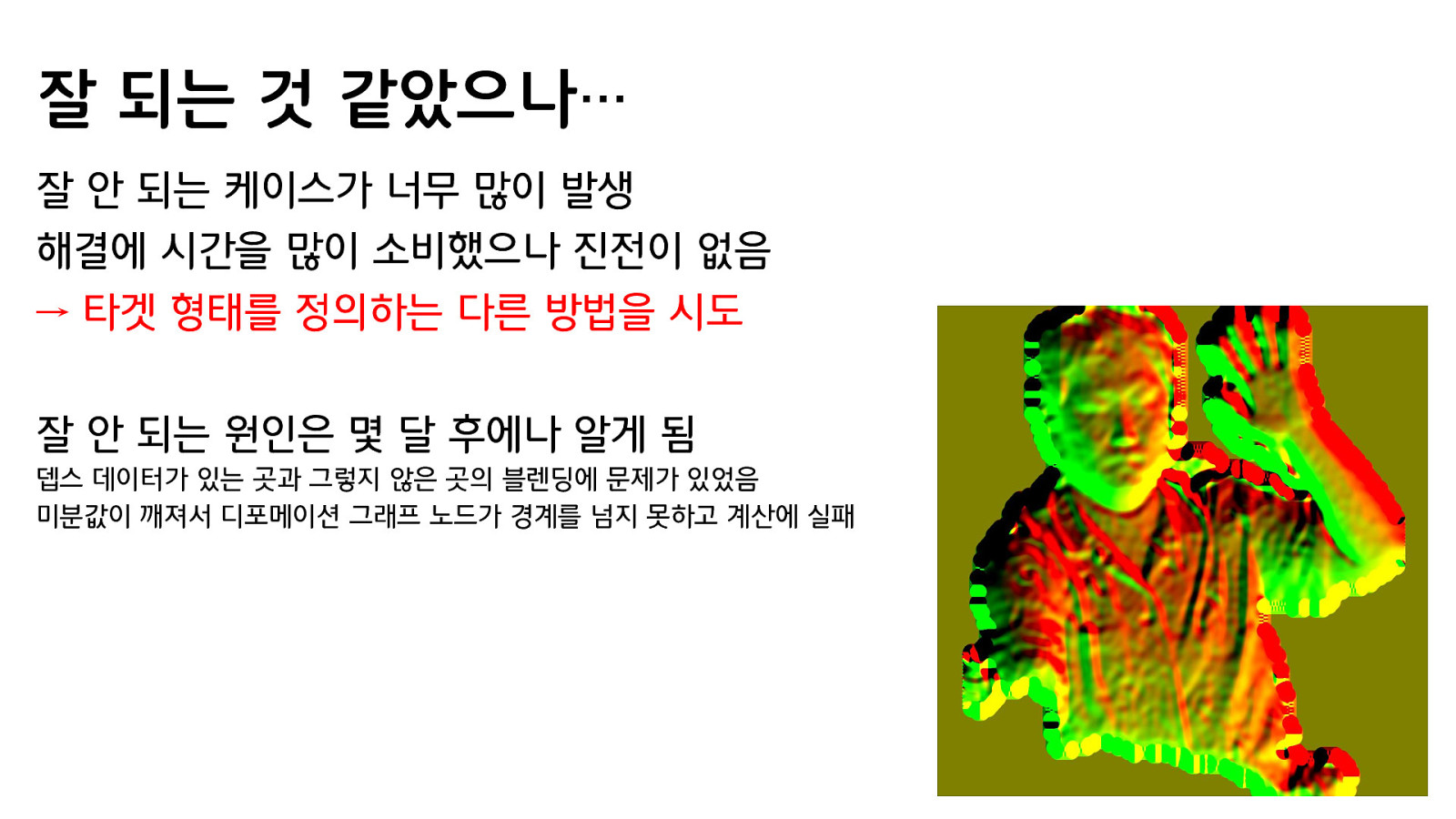

잘 되는 것 같았으나… 잘 안 되는 케이스가 너무 많이 발생 해결에 시간을 많이 소비했으나 진전이 없음 → 타겟 형태를 정의하는 다른 방법을 시도 잘 안 되는 원인은 몇 달 후에나 알게 됨 뎁스 데이터가 있는 곳과 그렇지 않은 곳의 블렌딩에 문제가 있었음 미분값이 깨져서 디포메이션 그래프 노드가 경계를 넘지 못하고 계산에 실패

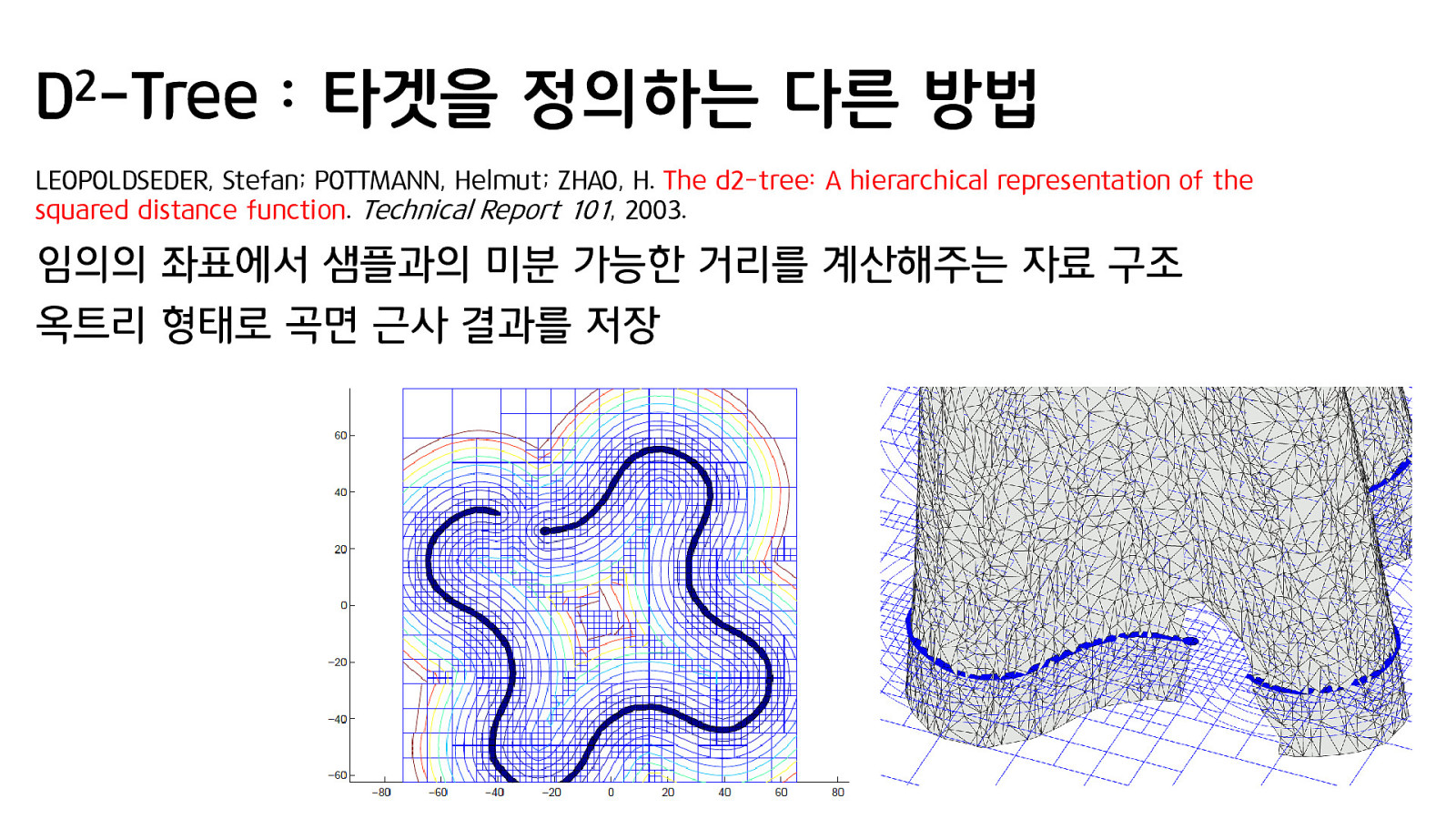

2 D -Tree : 타겟을 정의하는 다른 방법 LEOPOLDSEDER, Stefan; POTTMANN, Helmut; ZHAO, H. The d2-tree: A hierarchical representation of the squared distance function. Technical Report 101, 2003. 임의의 좌표에서 샘플과의 미분 가능한 거리를 계산해주는 자료 구조 옥트리 형태로 곡면 근사 결과를 저장

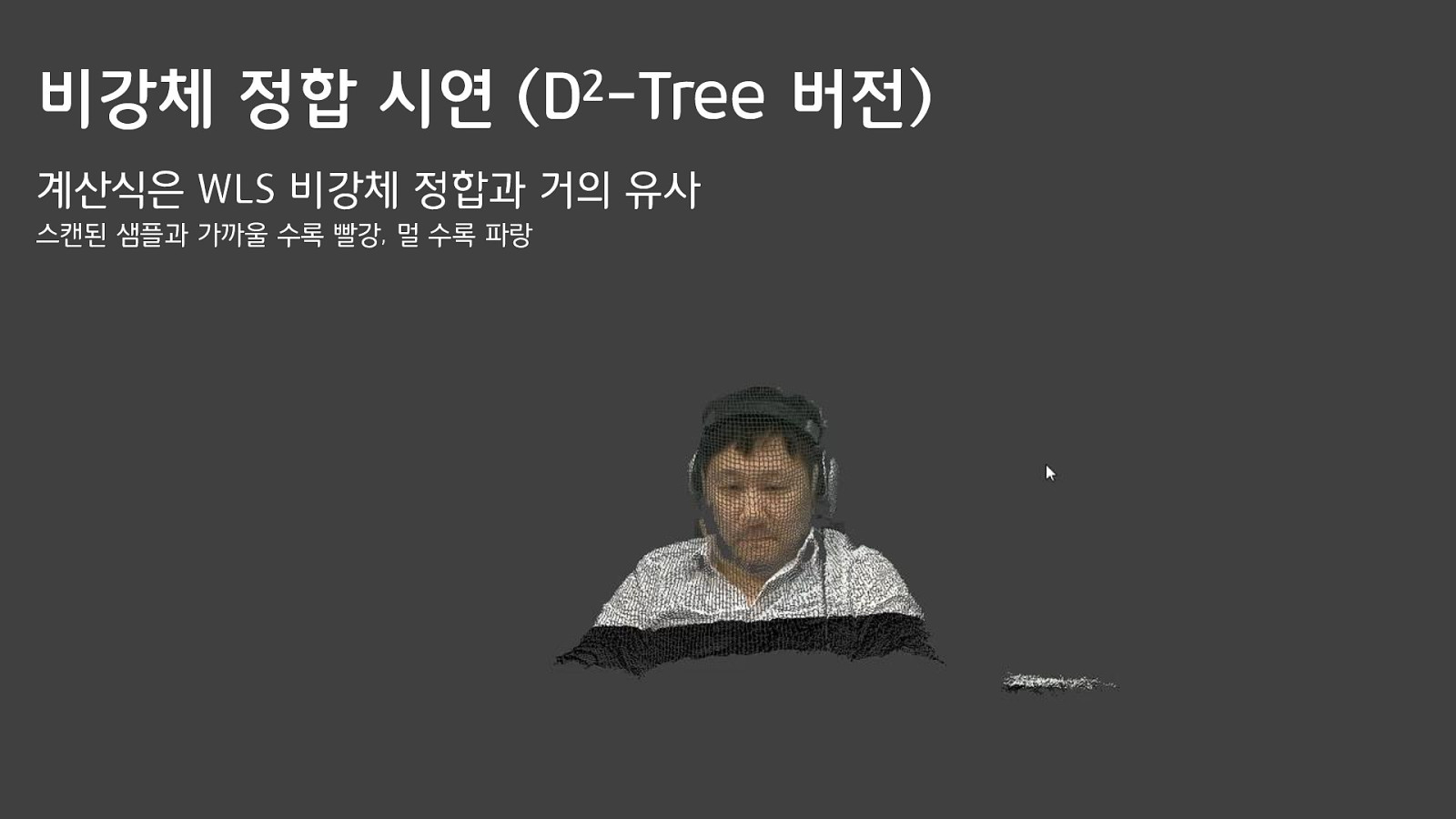

비강체 정합 시연 2 (D -Tree 계산식은 WLS 비강체 정합과 거의 유사 스캔된 샘플과 가까울 수록 빨강, 멀 수록 파랑 버전)

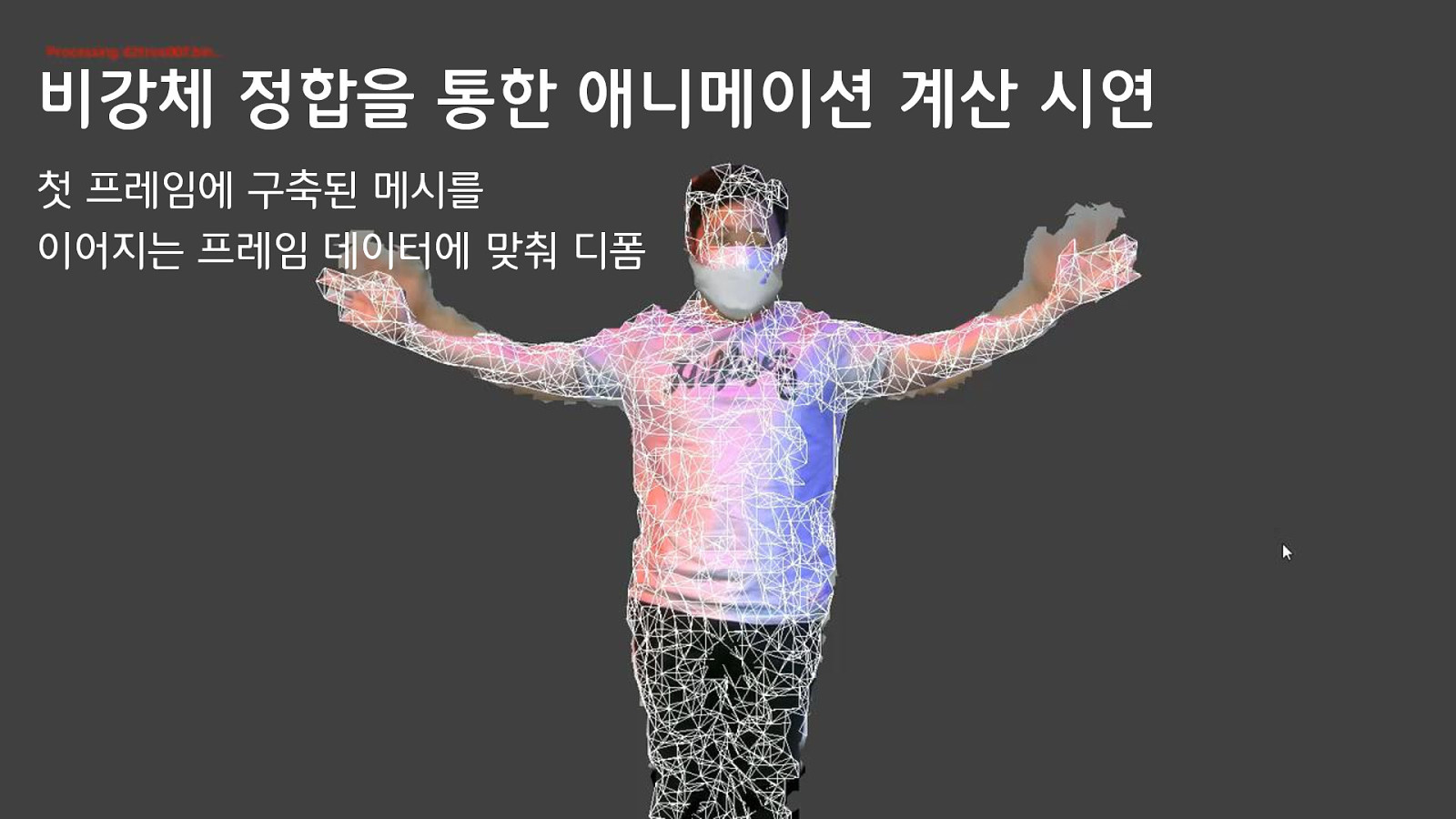

비강체 정합을 통한 애니메이션 계산 시연 첫 프레임에 구축된 메시를 이어지는 프레임 데이터에 맞춰 디폼

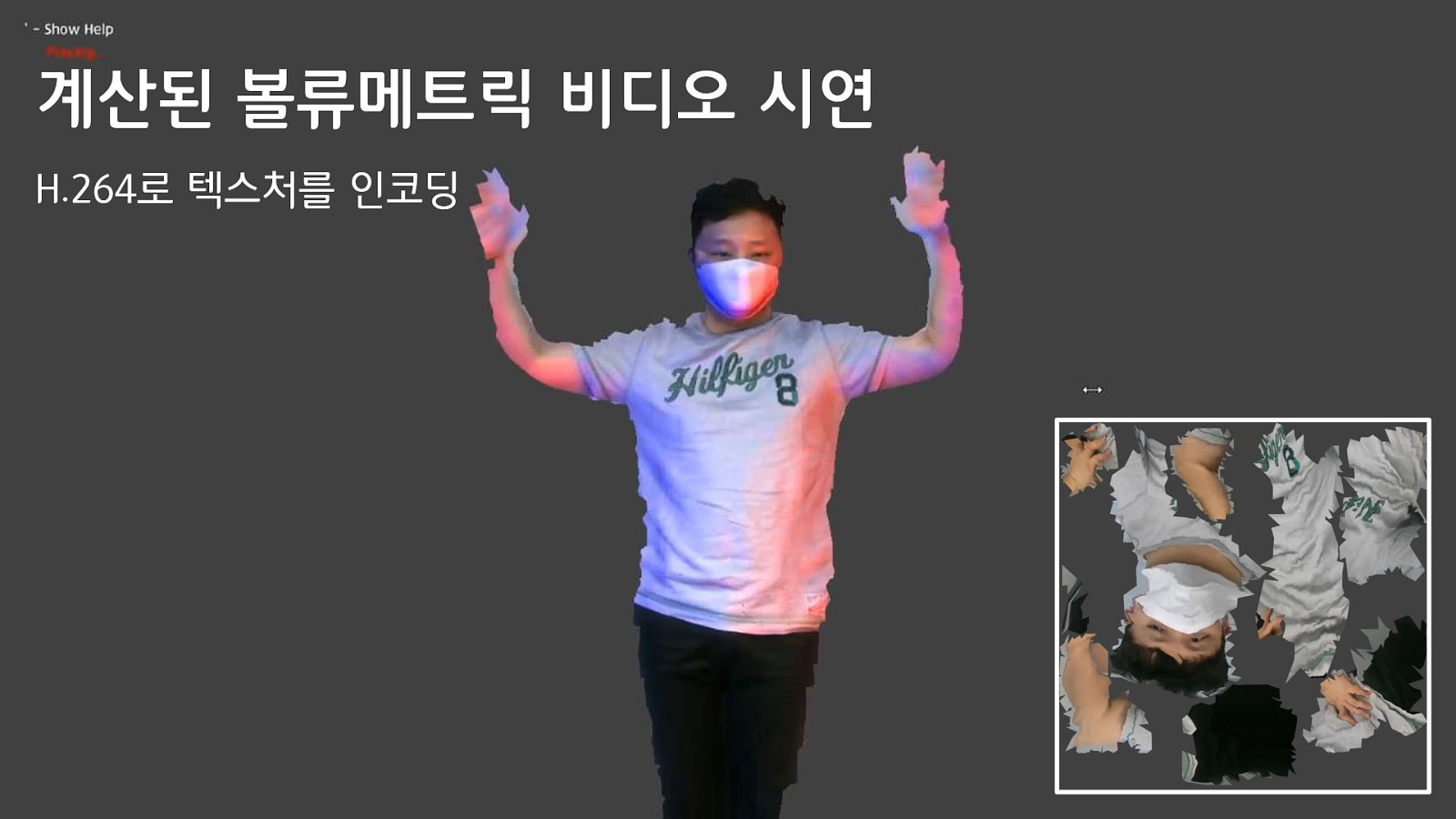

계산된 볼류메트릭 비디오 시연 H.264로 텍스처를 인코딩

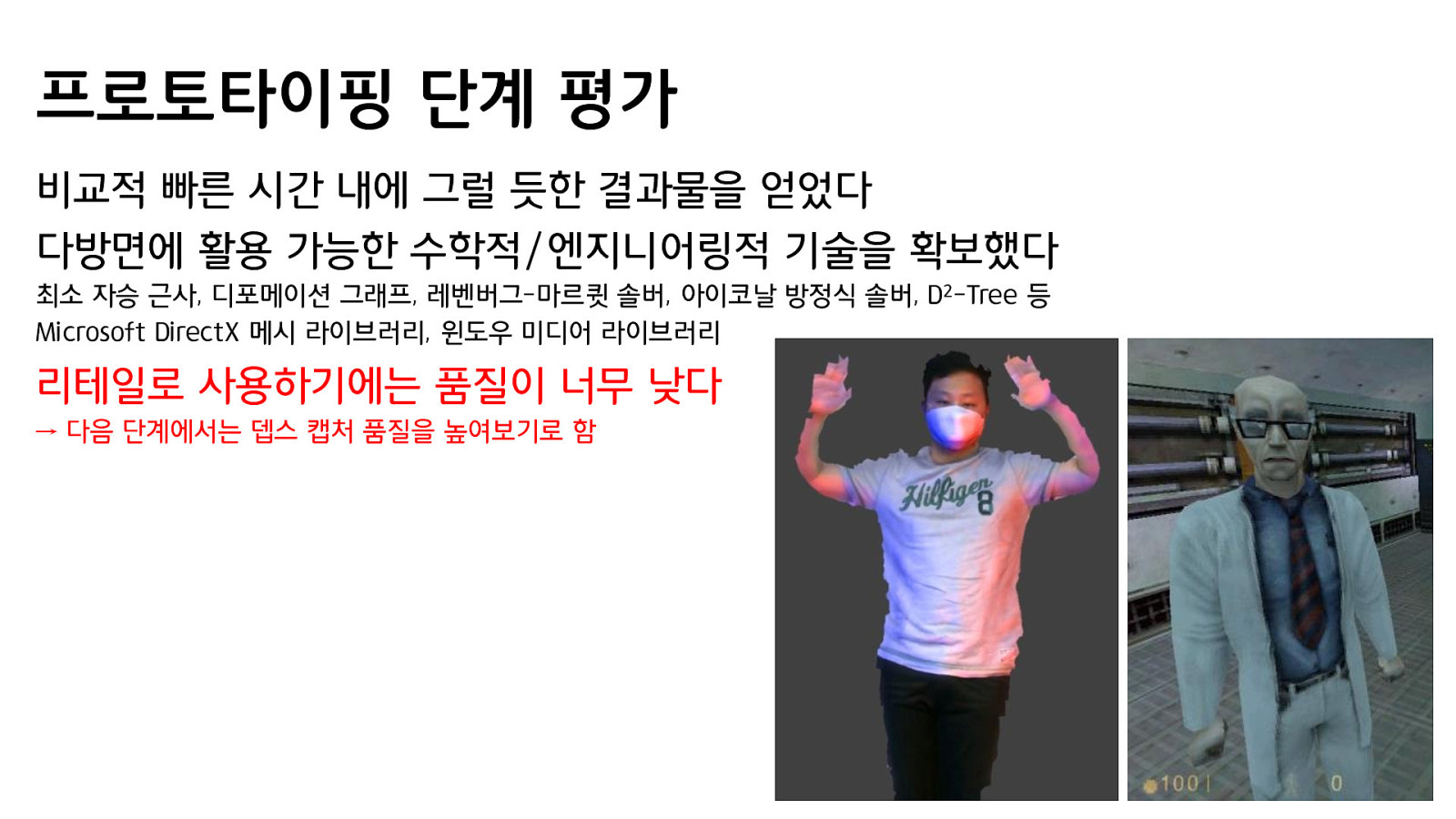

프로토타이핑 단계 평가 비교적 빠른 시간 내에 그럴 듯한 결과물을 얻었다 다방면에 활용 가능한 수학적/엔지니어링적 기술을 확보했다 최소 자승 근사, 디포메이션 그래프, 레벤버그-마르큇 솔버, 아이코날 방정식 솔버, D2-Tree 등 Microsoft DirectX 메시 라이브러리, 윈도우 미디어 라이브러리 리테일로 사용하기에는 품질이 너무 낮다 → 다음 단계에서는 뎁스 캡처 품질을 높여보기로 함

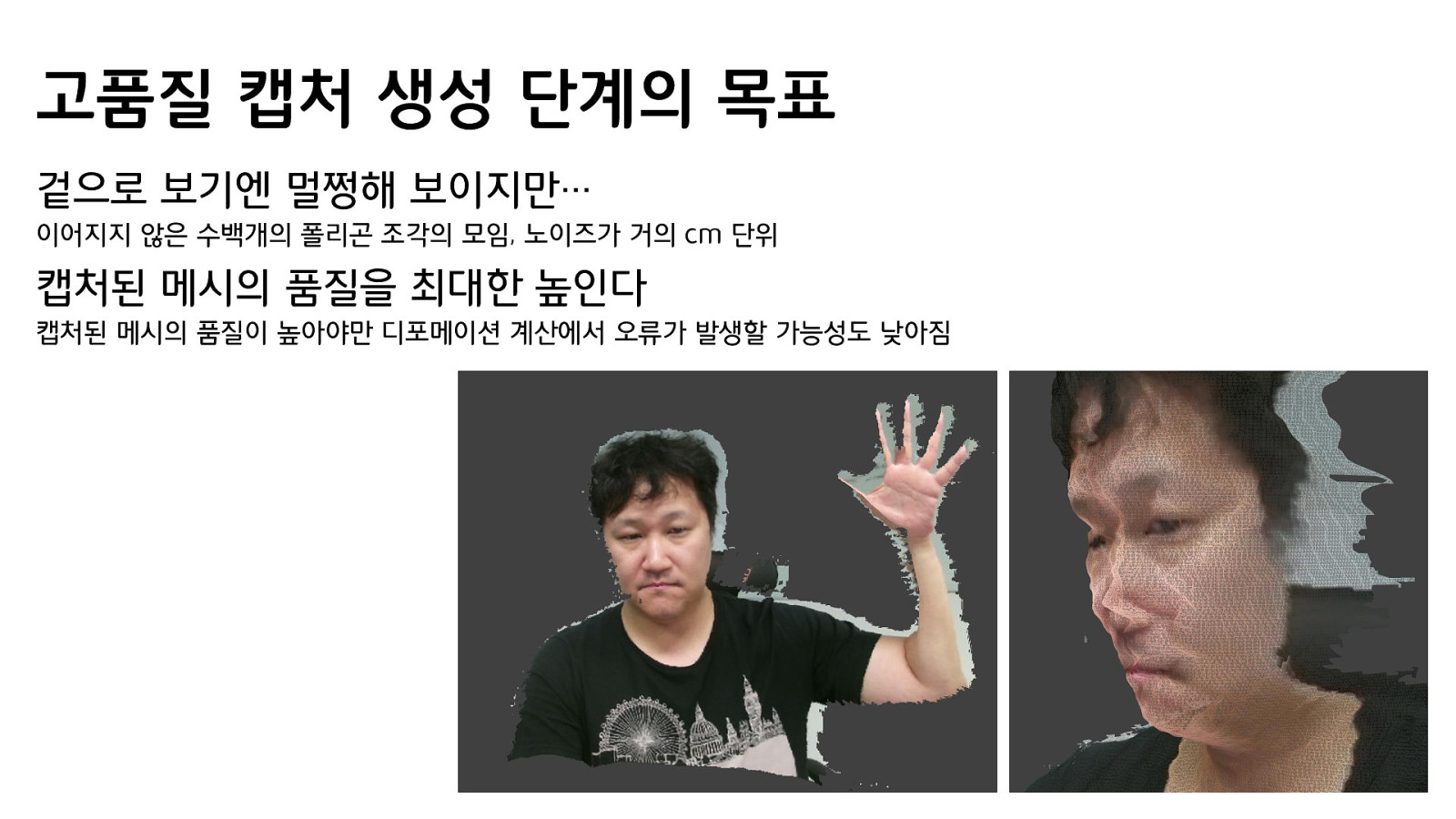

고품질 캡처 생성 단계의 목표 겉으로 보기엔 멀쩡해 보이지만… 이어지지 않은 수백개의 폴리곤 조각의 모임, 노이즈가 거의 cm 단위 캡처된 메시의 품질을 최대한 높인다 캡처된 메시의 품질이 높아야만 디포메이션 계산에서 오류가 발생할 가능성도 낮아짐

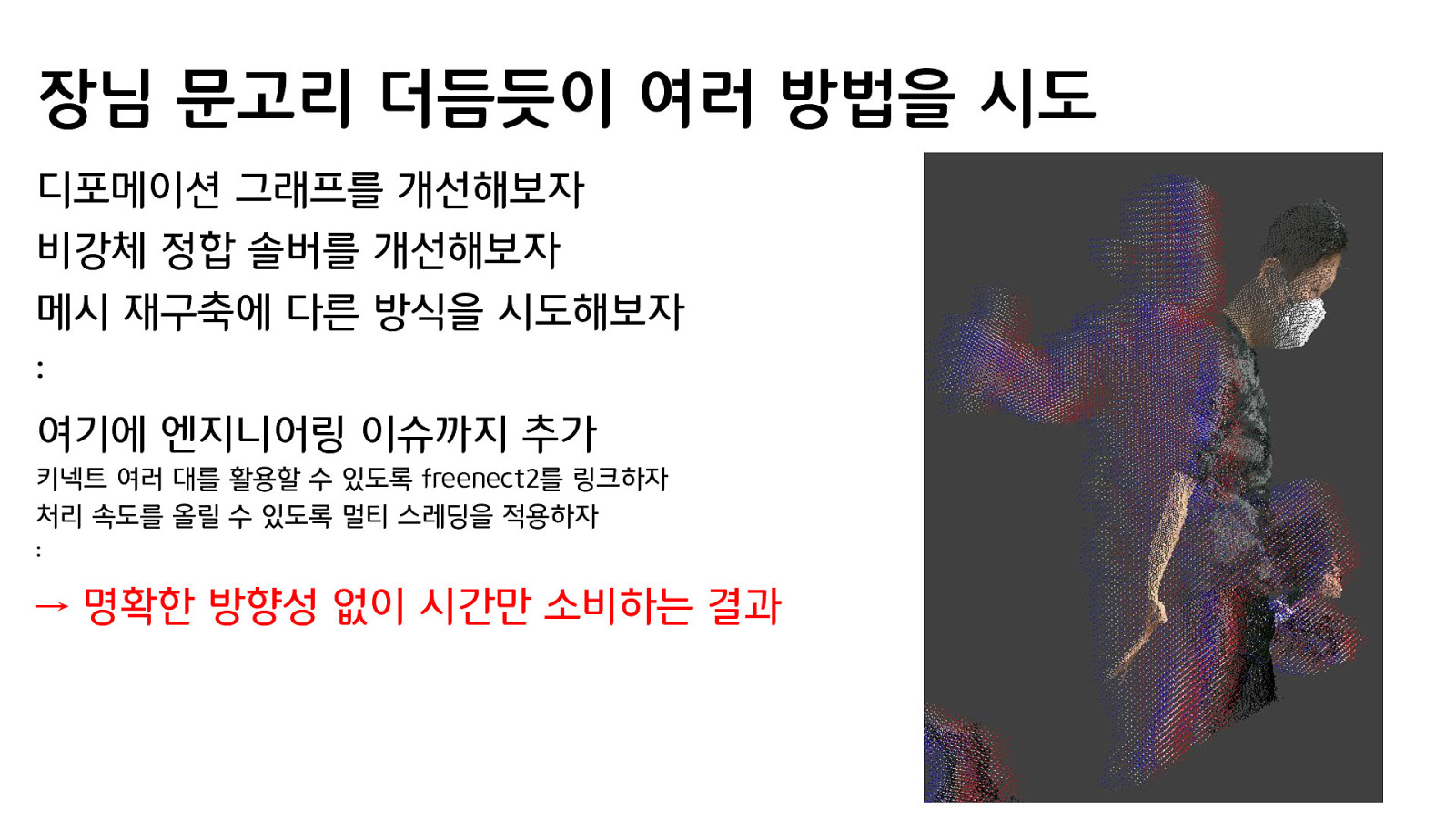

장님 문고리 더듬듯이 여러 방법을 시도 디포메이션 그래프를 개선해보자 비강체 정합 솔버를 개선해보자 메시 재구축에 다른 방식을 시도해보자 : 여기에 엔지니어링 이슈까지 추가 키넥트 여러 대를 활용할 수 있도록 freenect2를 링크하자 처리 속도를 올릴 수 있도록 멀티 스레딩을 적용하자 : → 명확한 방향성 없이 시간만 소비하는 결과

고품질 캡처 생성 (초기 시도) 단계 평가 기존 확보한 기술의 튜닝만으로 가능할 걸로 막연하게 판단하고 접근 한 장의 뎁스 이미지에서 얻을 수 있는 정보량의 한계가 명확했음 결과적으로 연구 측면의 효율은 낮았다 엔지니어링적으로는 기존 구현된 기술의 안정성과 효율성을 향상

3-a. 연속 비강체 정합을 통한 고품질 캡처 5월 16일~7월 6일 (약 1개월 반)

비강체 정합을 통한 고품질 캡처 생성 단계의 목표 여러 프레임을 누적시켜서 높은 품질의 스캔을 얻는 레퍼런스가 있다 NEWCOMBE, Richard A., et al. KinectFusion: Real-time dense surface mapping and tracking. In: Mixed and augmented reality (ISMAR), 2011 10th IEEE international symposium on. IEEE, 2011. p. 127-136. 뎁스 스캔을 비강체 정합하는 방향을 시도 레퍼런스 방식으로는 GPU 메모리로 메시의 최대 해상도가 제한 기존 확보한 기술을 최대한 활용해서 빠르게 결과를 얻기로 결정 → 몇 달 후 잘못된 결정임을 알게 됨 TSDF를 사용하느냐 마느냐가 크리티컬하게 중요한 문제

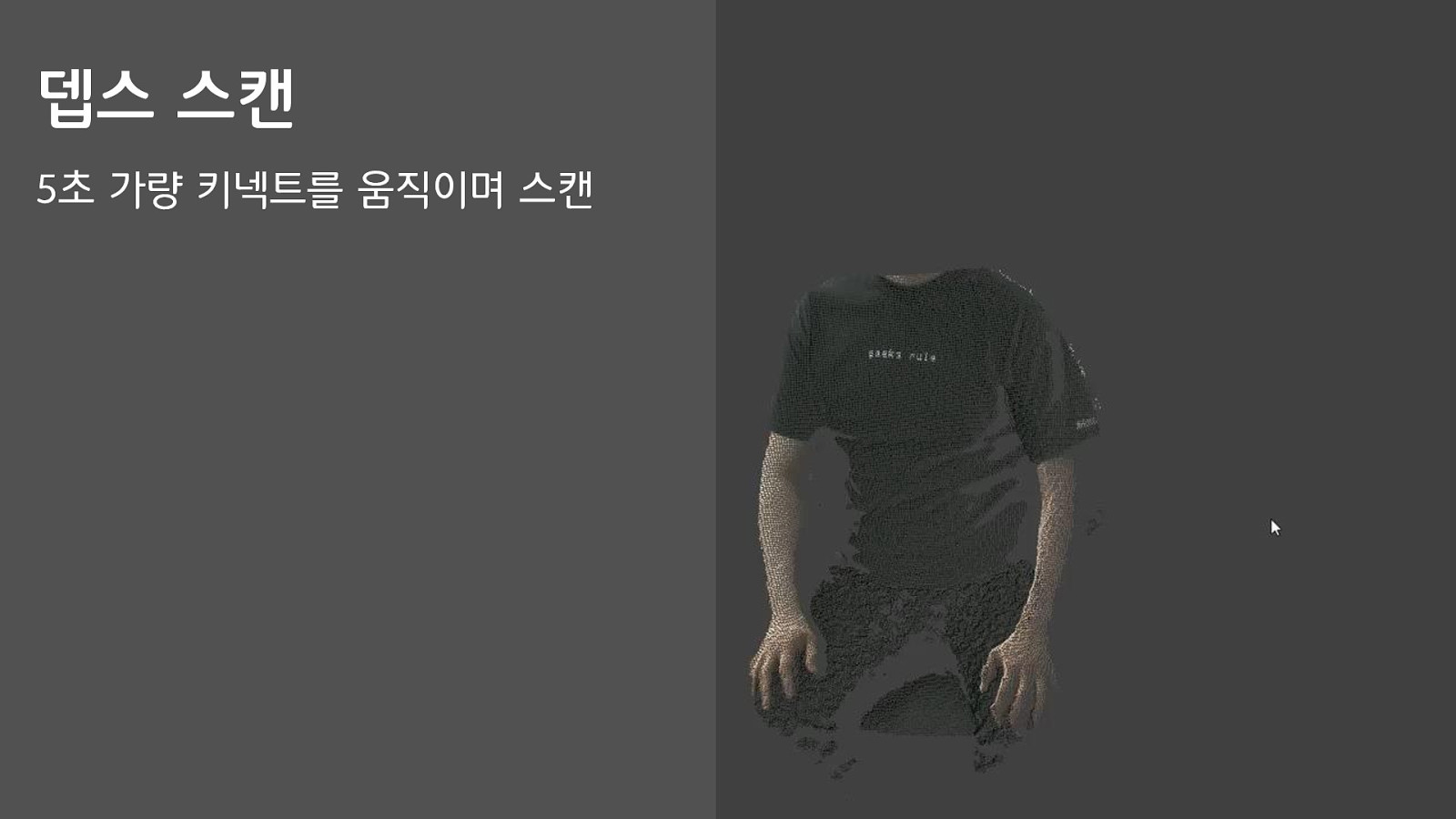

뎁스 스캔 5초 가량 키넥트를 움직이며 스캔

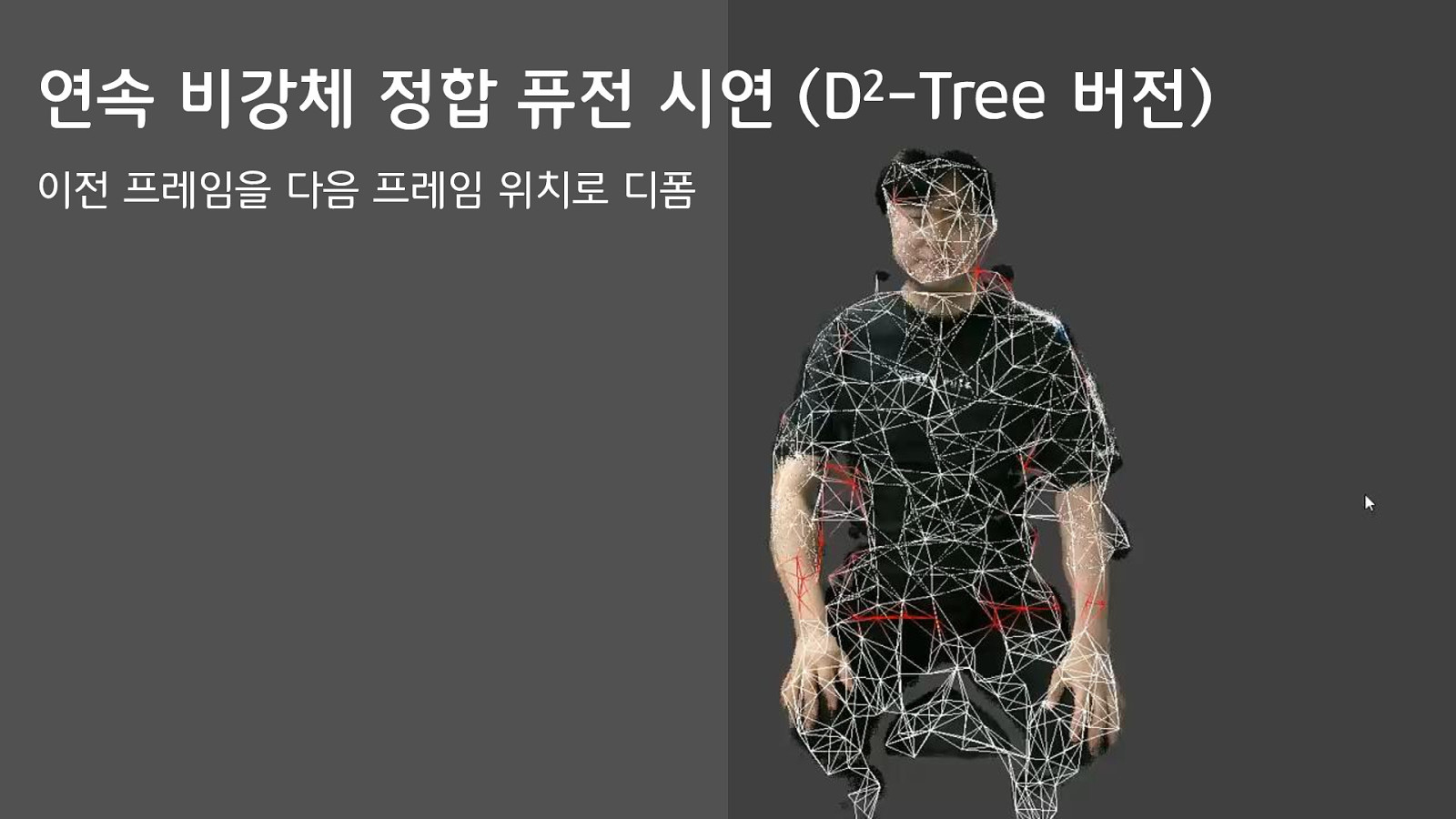

연속 비강체 정합 퓨전 시연 이전 프레임을 다음 프레임 위치로 디폼 2 (D -Tree 버전)

퓨전 결과 그럴싸해 보이긴 하는데…

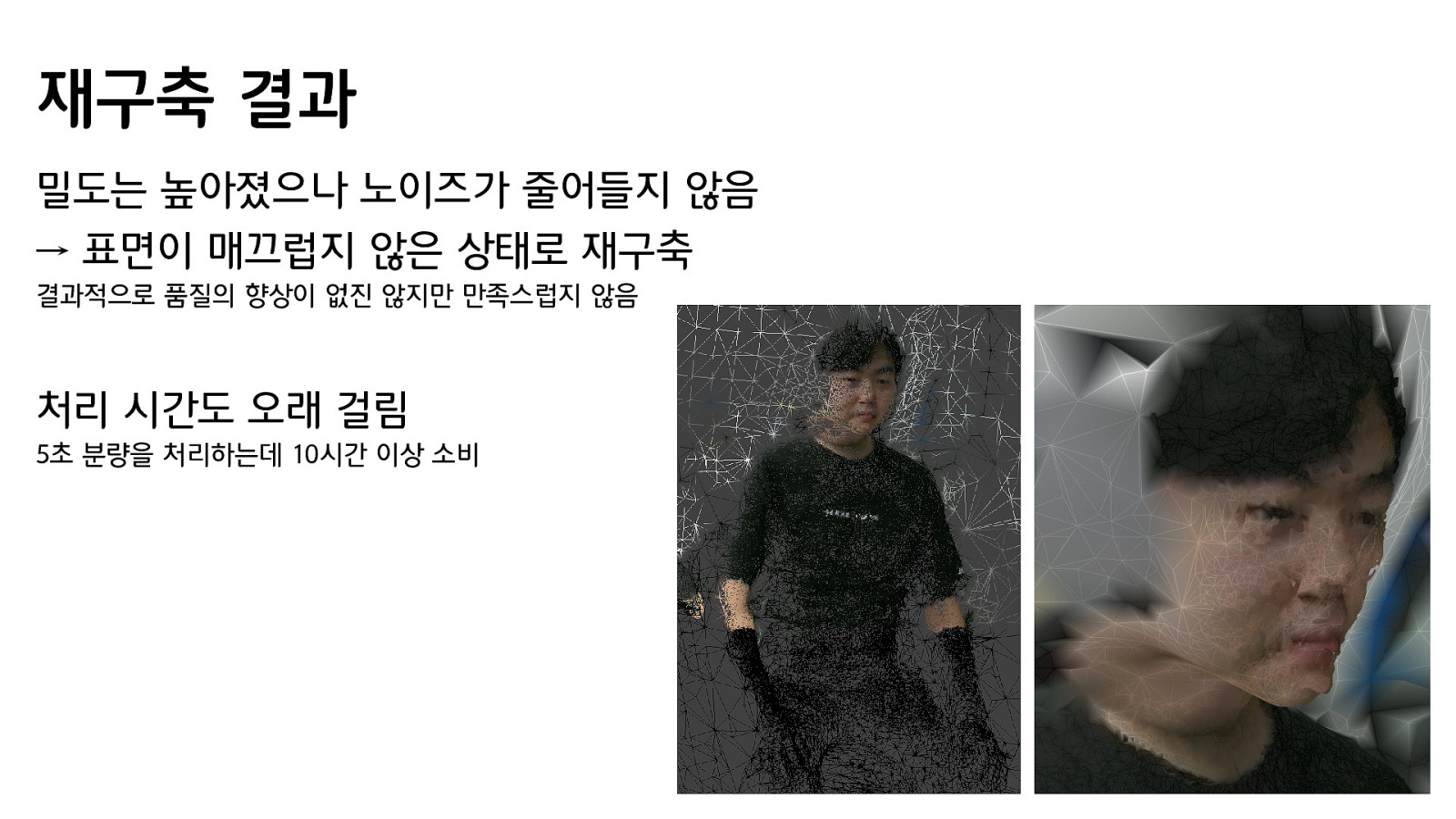

재구축 결과 밀도는 높아졌으나 노이즈가 줄어들지 않음 → 표면이 매끄럽지 않은 상태로 재구축 결과적으로 품질의 향상이 없진 않지만 만족스럽지 않음 처리 시간도 오래 걸림 5초 분량을 처리하는데 10시간 이상 소비

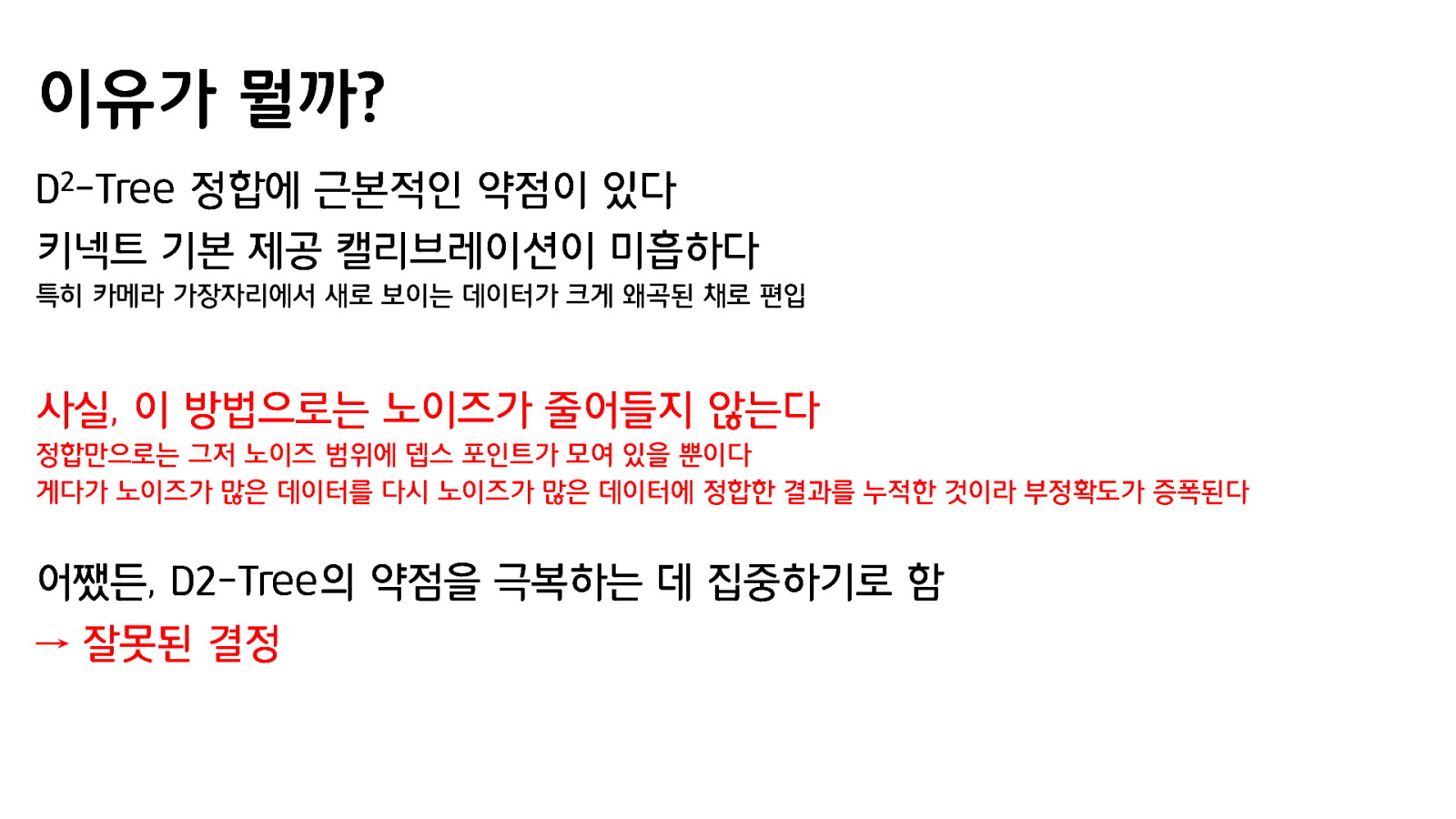

이유가 뭘까? D2-Tree 정합에 근본적인 약점이 있다 키넥트 기본 제공 캘리브레이션이 미흡하다 특히 카메라 가장자리에서 새로 보이는 데이터가 크게 왜곡된 채로 편입 사실, 이 방법으로는 노이즈가 줄어들지 않는다 정합만으로는 그저 노이즈 범위에 뎁스 포인트가 모여 있을 뿐이다 게다가 노이즈가 많은 데이터를 다시 노이즈가 많은 데이터에 정합한 결과를 누적한 것이라 부정확도가 증폭된다 어쨌든, D2-Tree의 약점을 극복하는 데 집중하기로 함 → 잘못된 결정

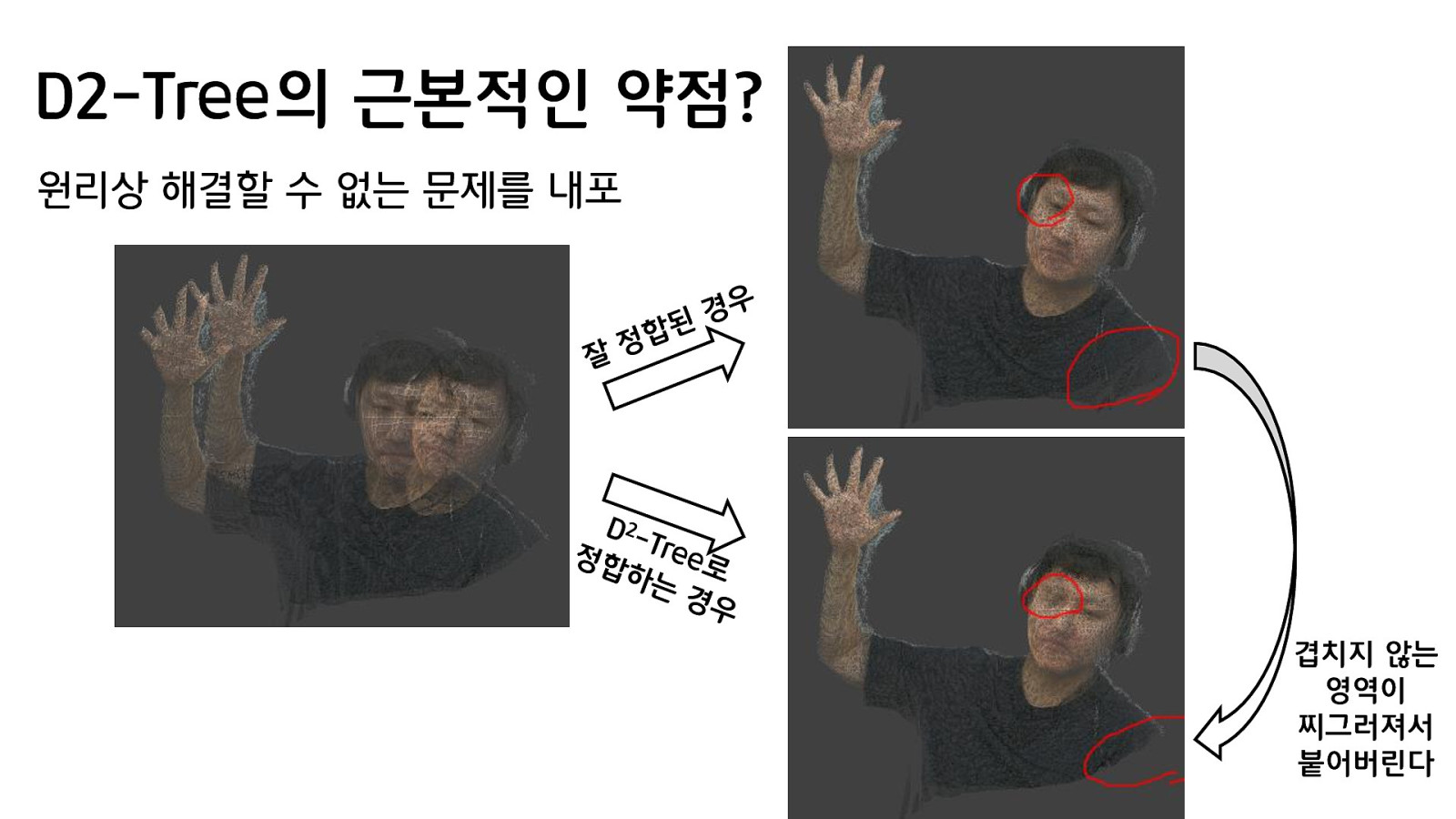

D2-Tree의 근본적인 약점? 원리상 해결할 수 없는 문제를 내포 겹치지 않는 영역이 찌그러져서 붙어버린다

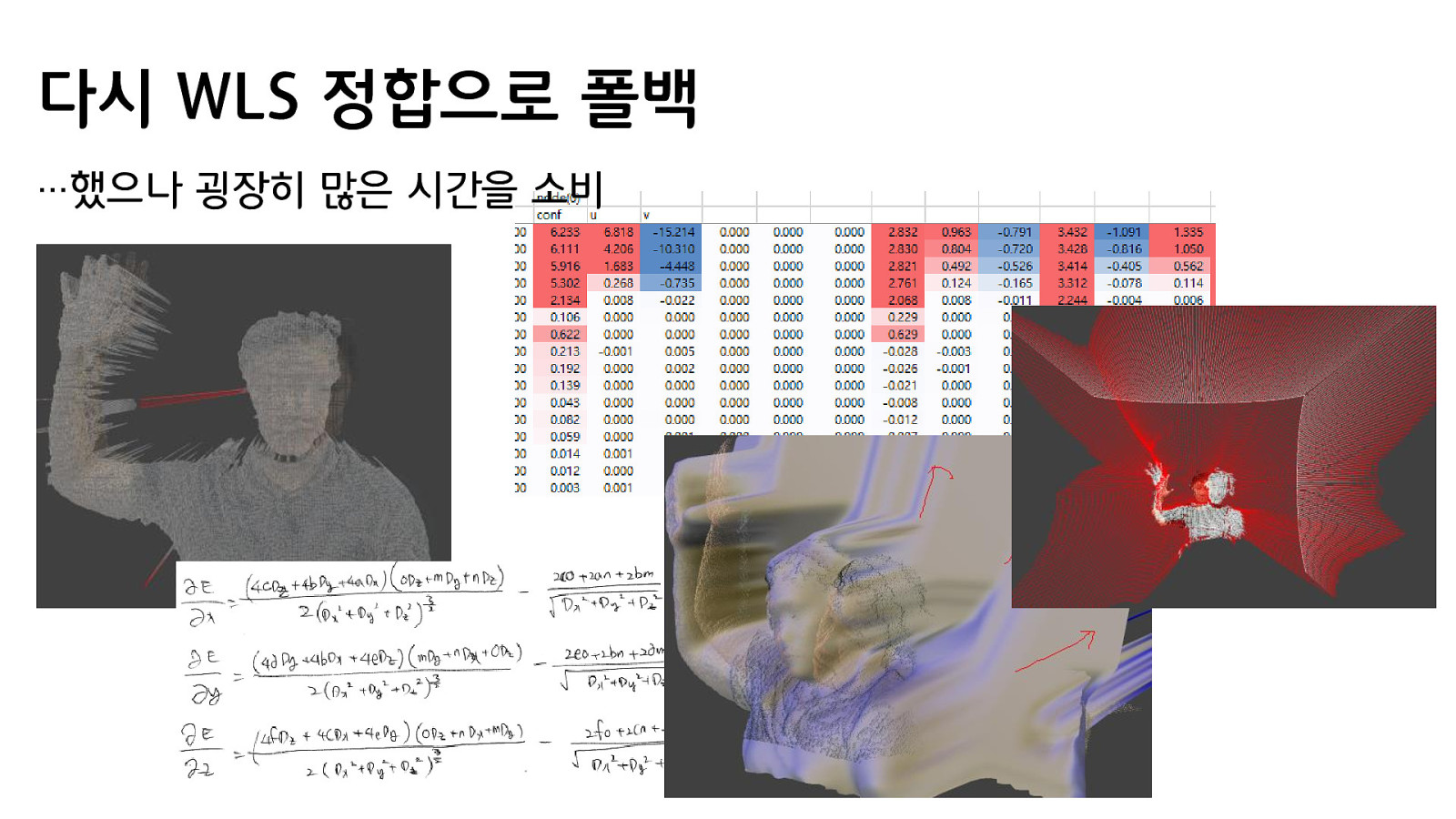

다시 WLS 정합으로 폴백 …했으나 굉장히 많은 시간을 소비

연속 비강체 정합 퓨전 시연 (WLS 버전) 약간 더 좋은 정합 결과를 얻음

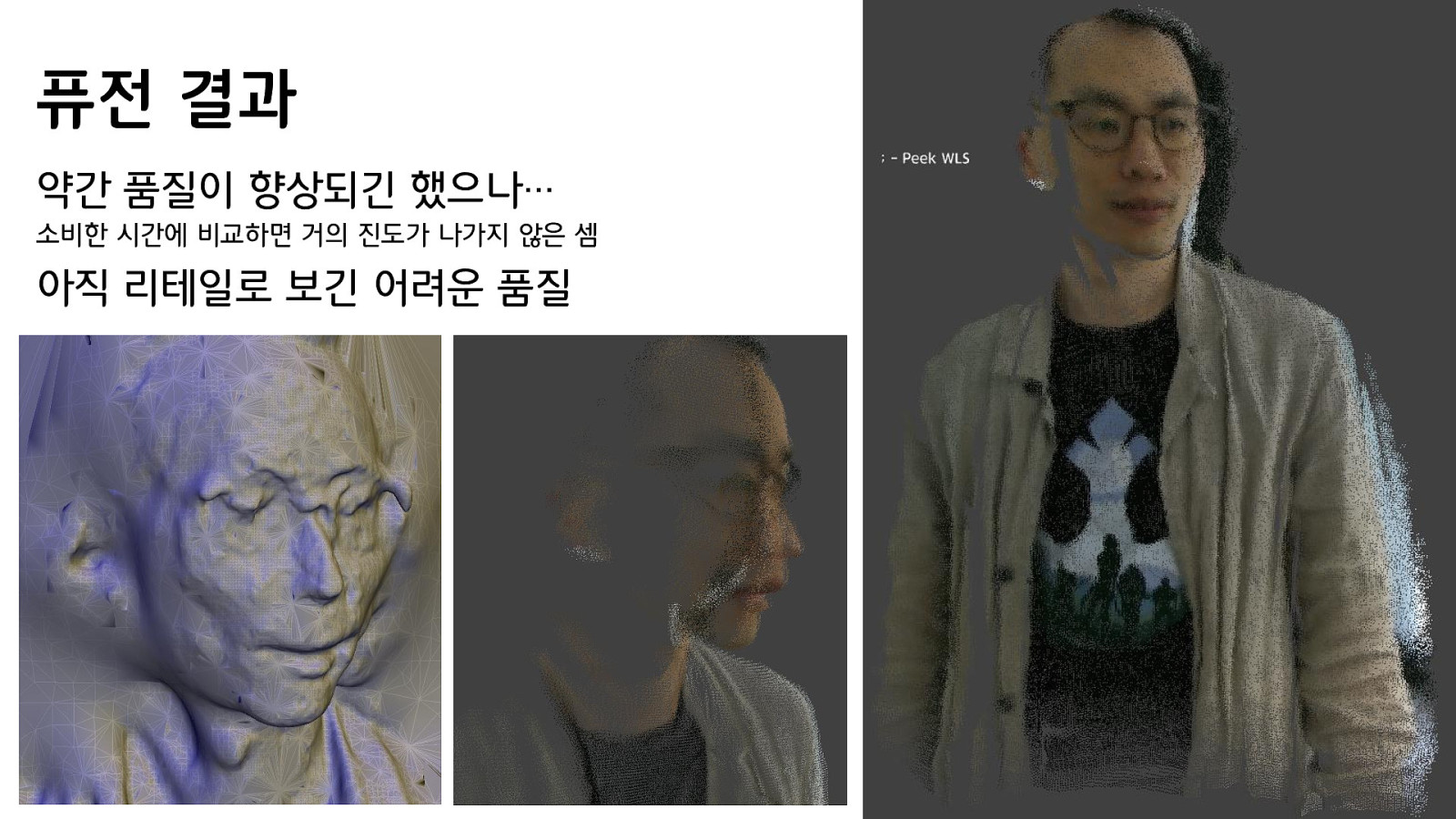

퓨전 결과 약간 품질이 향상되긴 했으나… 소비한 시간에 비교하면 거의 진도가 나가지 않은 셈 아직 리테일로 보긴 어려운 품질

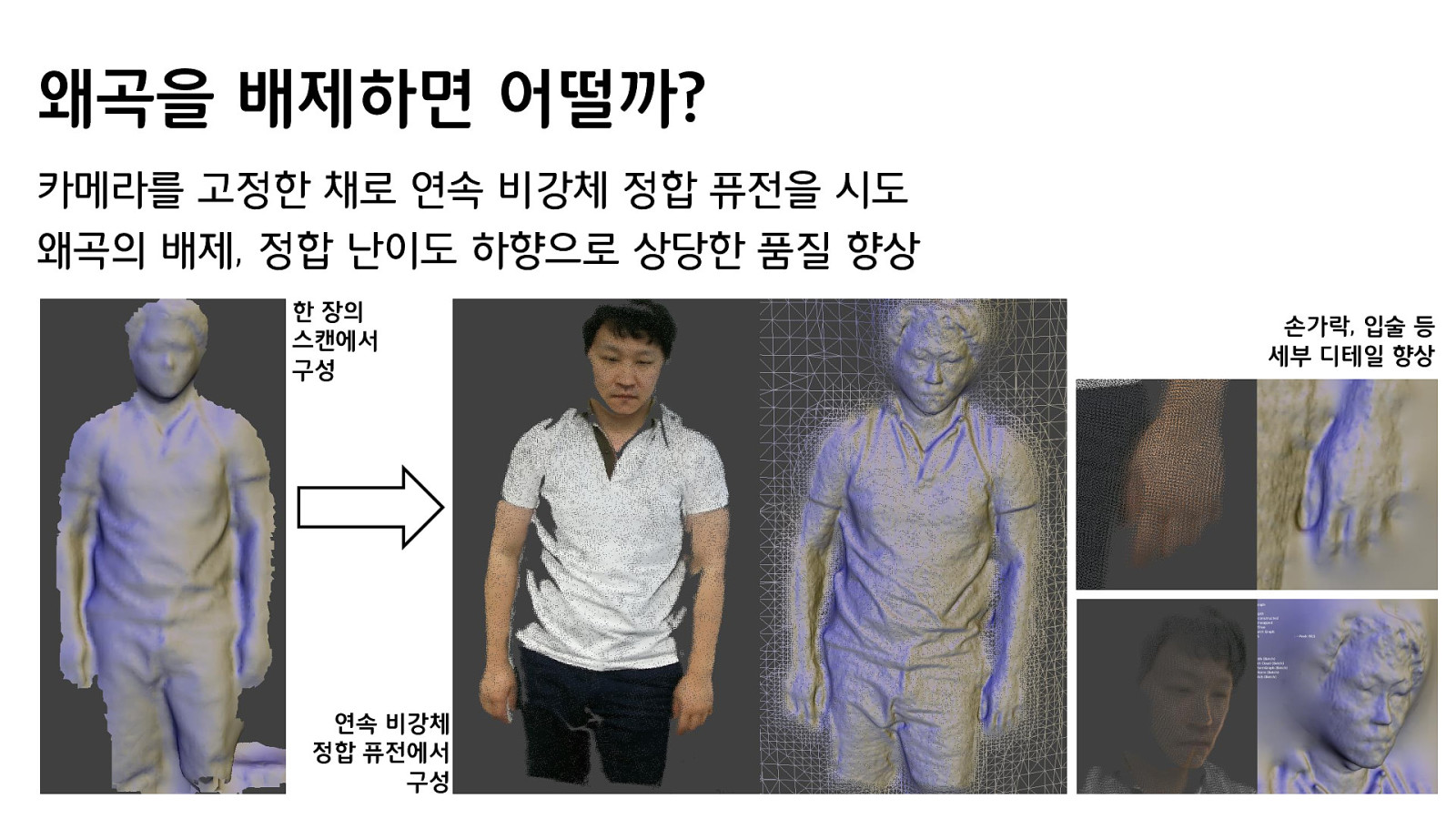

왜곡을 배제하면 어떨까? 카메라를 고정한 채로 연속 비강체 정합 퓨전을 시도 왜곡의 배제, 정합 난이도 하향으로 상당한 품질 향상 한 장의 스캔에서 구성 연속 비강체 정합 퓨전에서 구성 손가락, 입술 등 세부 디테일 향상

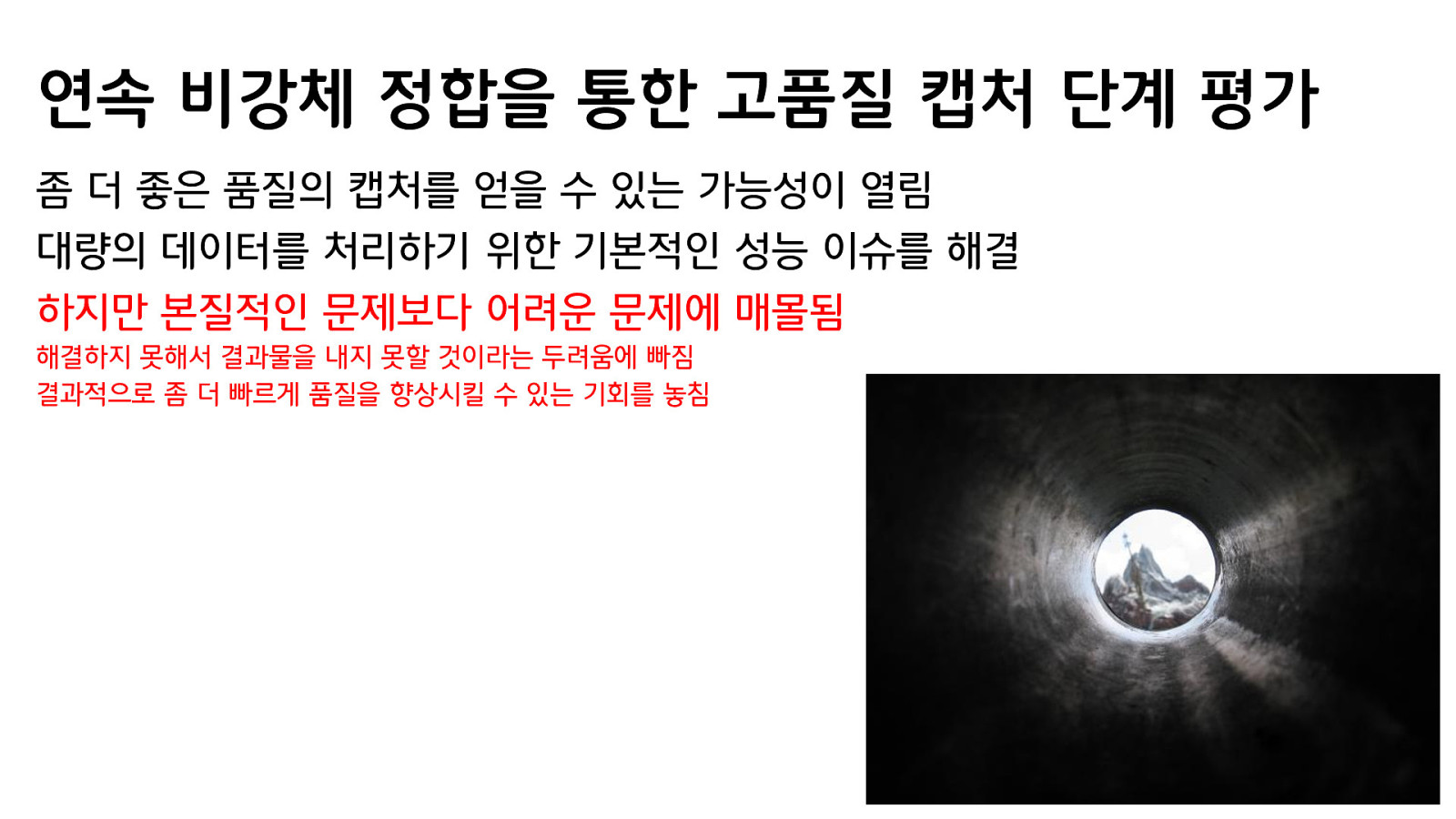

연속 비강체 정합을 통한 고품질 캡처 단계 평가 좀 더 좋은 품질의 캡처를 얻을 수 있는 가능성이 열림 대량의 데이터를 처리하기 위한 기본적인 성능 이슈를 해결 하지만 본질적인 문제보다 어려운 문제에 매몰됨 해결하지 못해서 결과물을 내지 못할 것이라는 두려움에 빠짐 결과적으로 좀 더 빠르게 품질을 향상시킬 수 있는 기회를 놓침

3-b. 수퍼 해상도를 활용한 고품질 캡처 7월 6일~8월 1일 (약 1개월)

수퍼 해상도를 활용한 고품질 캡처 단계의 목표 카메라를 고정시킨 퓨전으로 상당한 품질 향상을 거뒀다 하지만 노이즈가 억제되지 않아서 리테일 품질로 보기 어려움 수퍼 해상도 등 필터링을 거쳐 노이즈를 억제하고 재구축 품질을 높인다

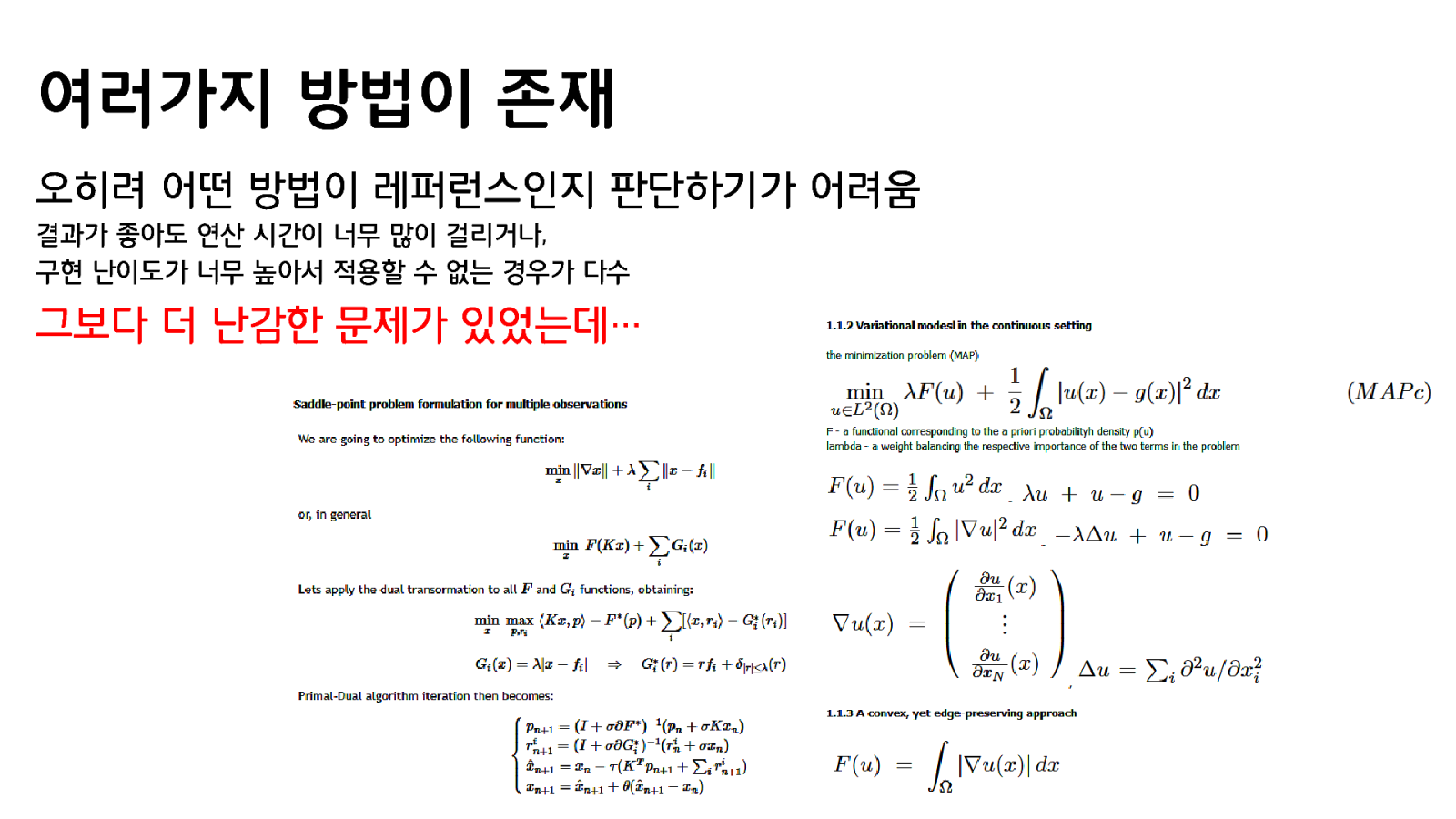

여러가지 방법이 존재 오히려 어떤 방법이 레퍼런스인지 판단하기가 어려움 결과가 좋아도 연산 시간이 너무 많이 걸리거나, 구현 난이도가 너무 높아서 적용할 수 없는 경우가 다수 그보다 더 난감한 문제가 있었는데…

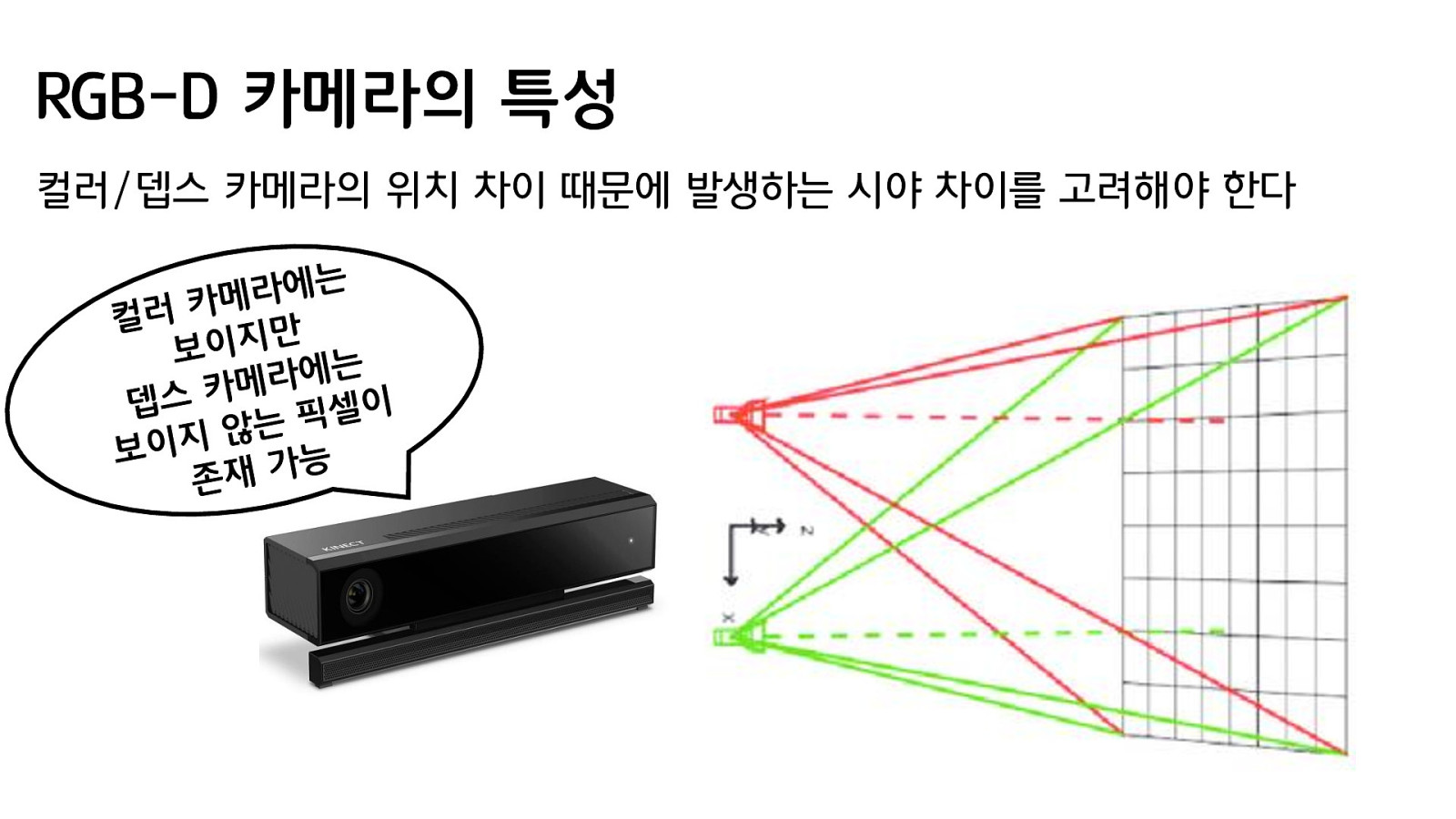

RGB-D 카메라의 특성 컬러/뎁스 카메라의 위치 차이 때문에 발생하는 시야 차이를 고려해야 한다

뎁스-컬러 이미지 정합을 거치면… 뎁스 픽셀이 불균일하게 흩어지고, 서로 가리는 영역이 발생 → 일반적인 이미지 프로세싱에서 고려하지 않는 조건 뎁스에서 컬러로 정합

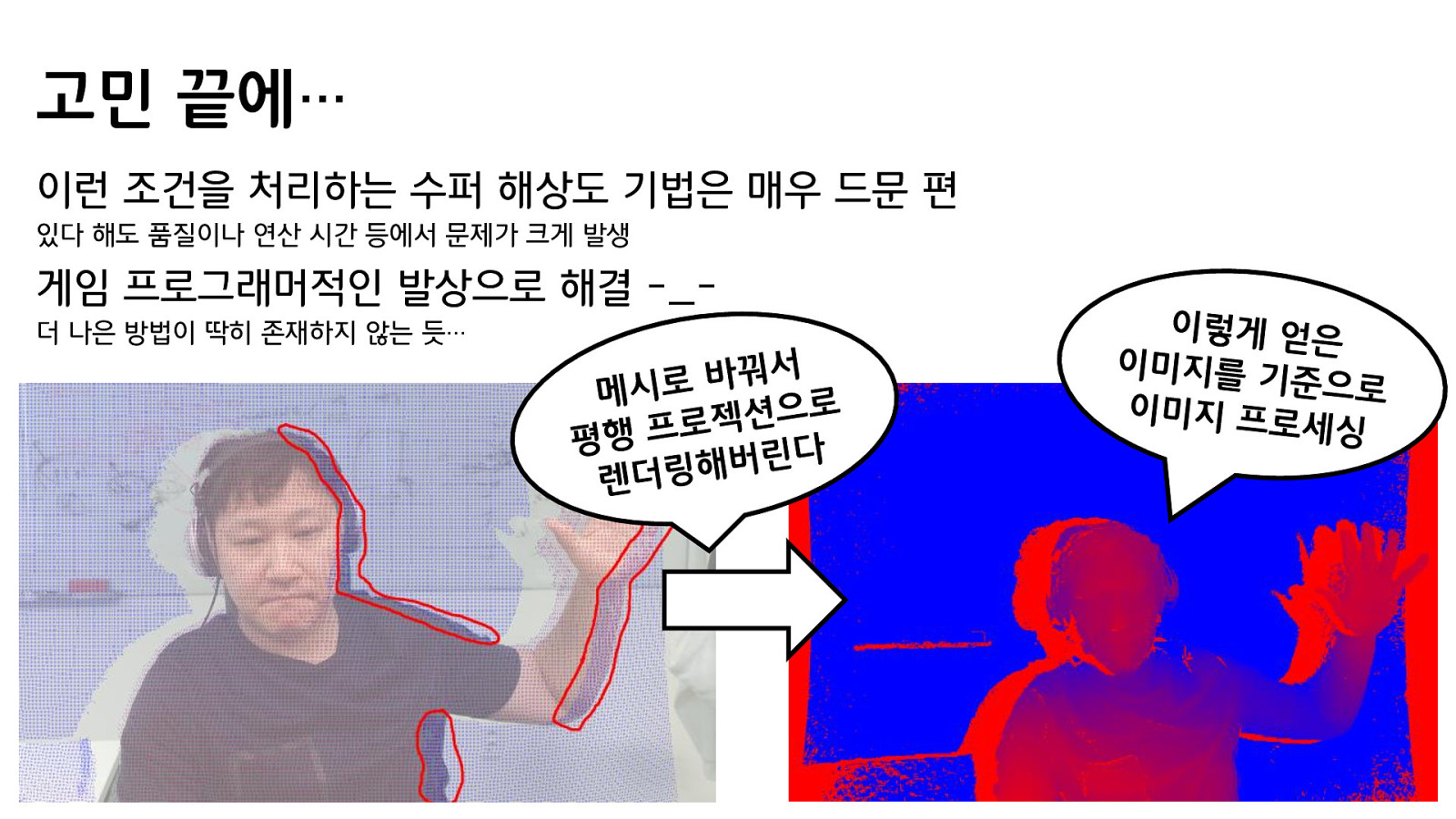

고민 끝에… 이런 조건을 처리하는 수퍼 해상도 기법은 매우 드문 편 있다 해도 품질이나 연산 시간 등에서 문제가 크게 발생 게임 프로그래머적인 발상으로 해결 -_더 나은 방법이 딱히 존재하지 않는 듯…

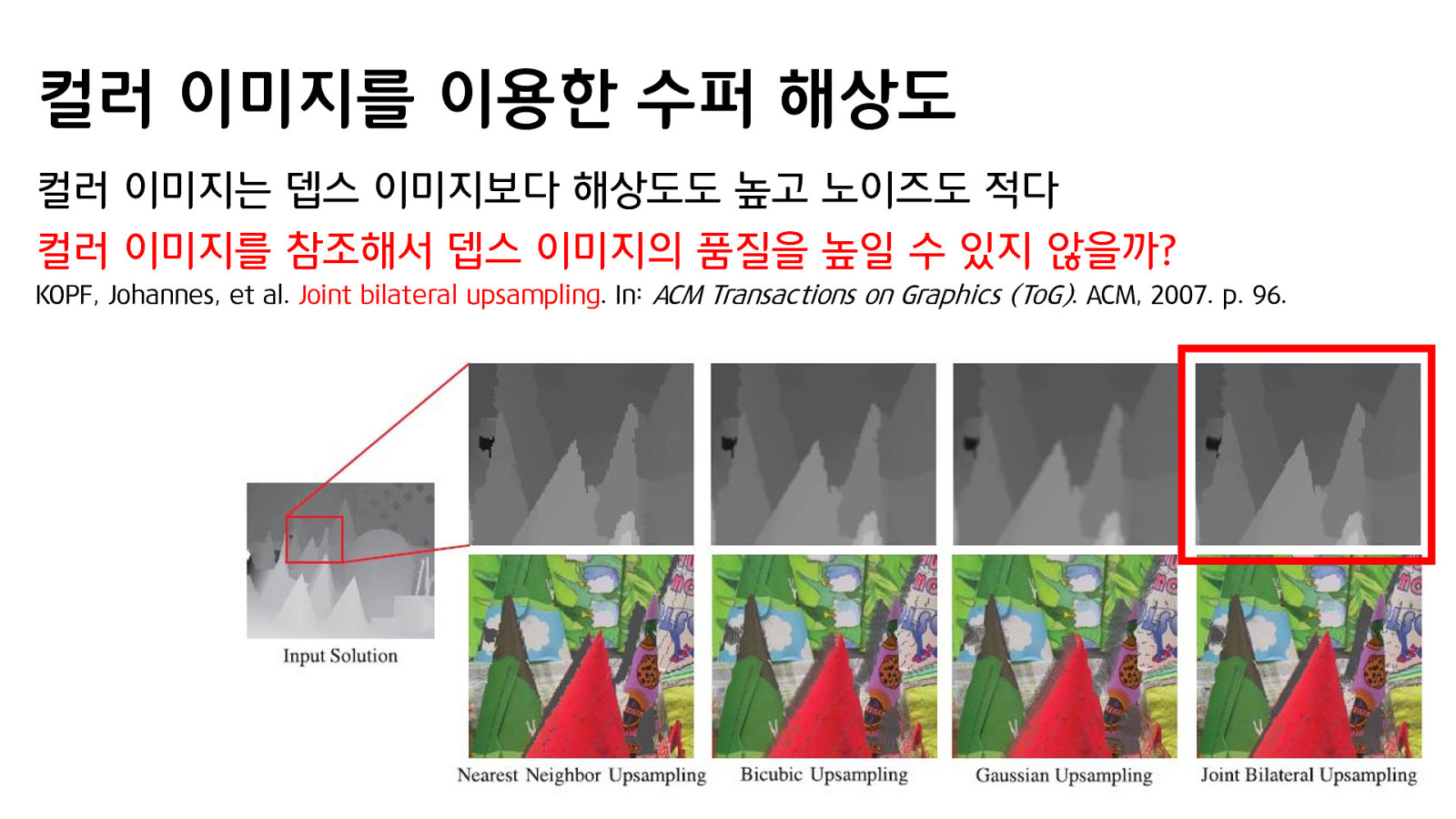

컬러 이미지를 이용한 수퍼 해상도 컬러 이미지는 뎁스 이미지보다 해상도도 높고 노이즈도 적다 컬러 이미지를 참조해서 뎁스 이미지의 품질을 높일 수 있지 않을까? KOPF, Johannes, et al. Joint bilateral upsampling. In: ACM Transactions on Graphics (ToG). ACM, 2007. p. 96.

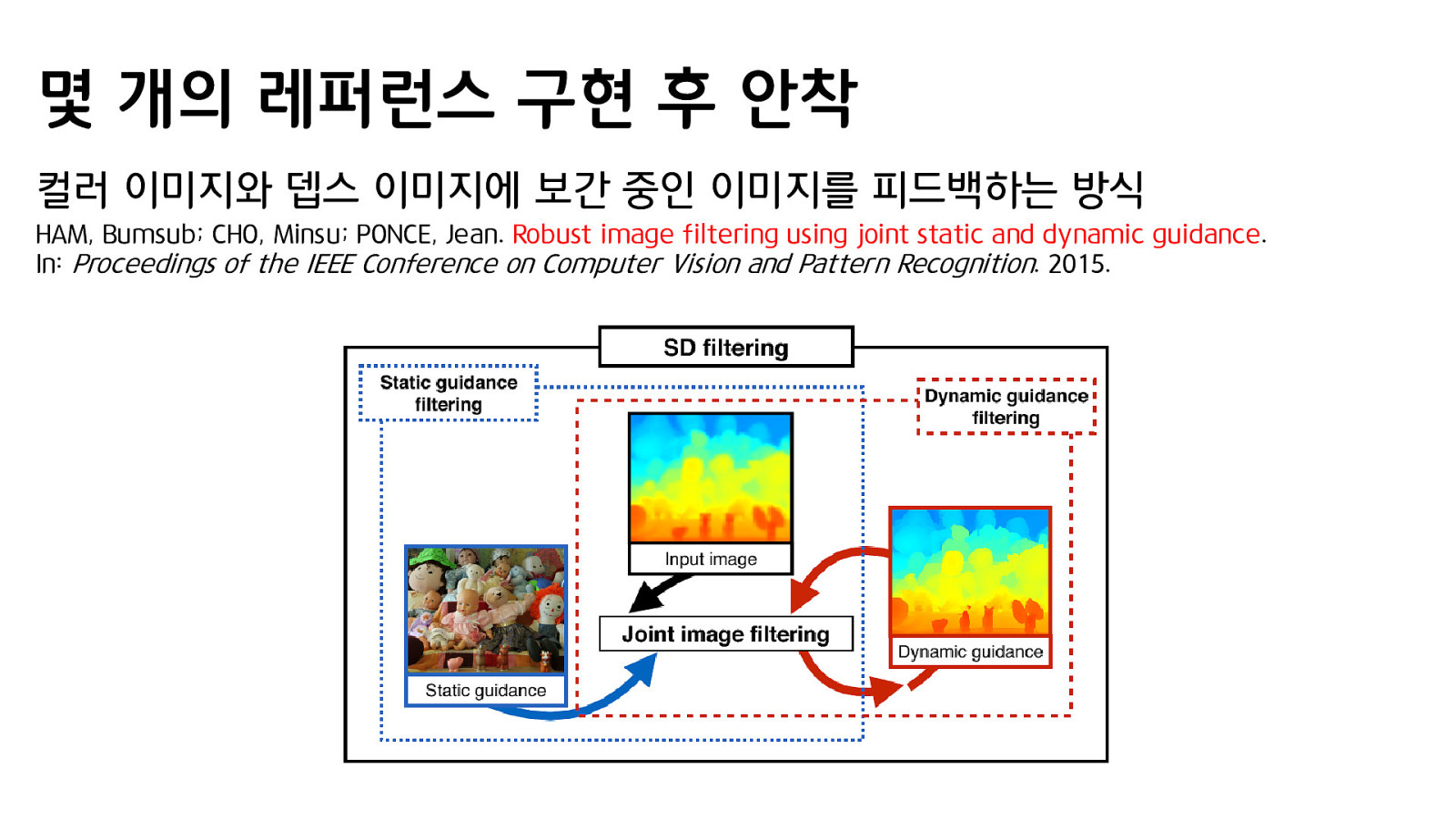

몇 개의 레퍼런스 구현 후 안착 컬러 이미지와 뎁스 이미지에 보간 중인 이미지를 피드백하는 방식 HAM, Bumsub; CHO, Minsu; PONCE, Jean. Robust image filtering using joint static and dynamic guidance. In: Proceedings of the IEEE Conference on Computer Vision and Pattern Recognition. 2015.

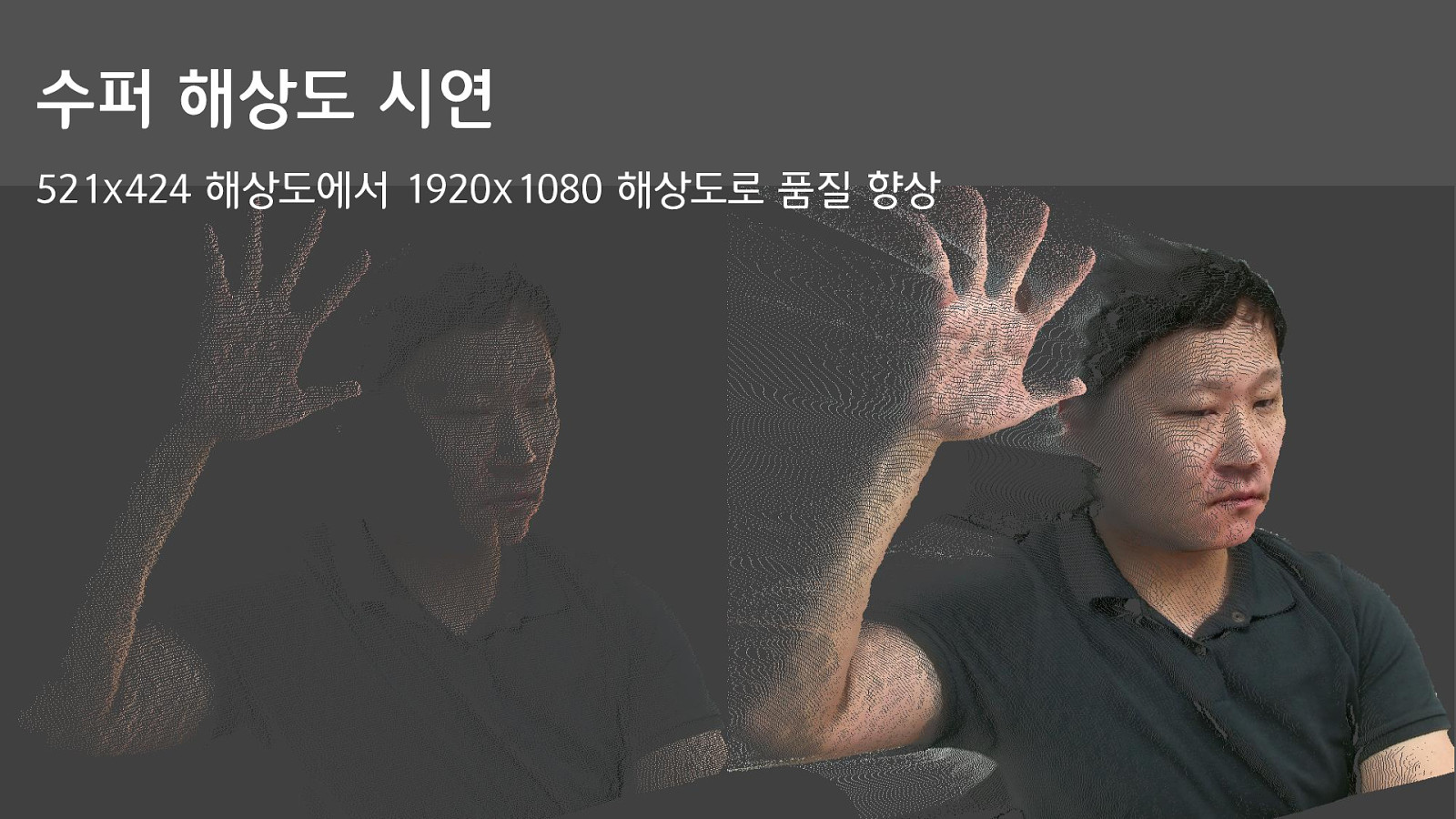

수퍼 해상도 시연 521x424 해상도에서 1920x1080 해상도로 품질 향상

수퍼 해상도 시연 근접에서 노이즈도 저감된 것을 확인 가능

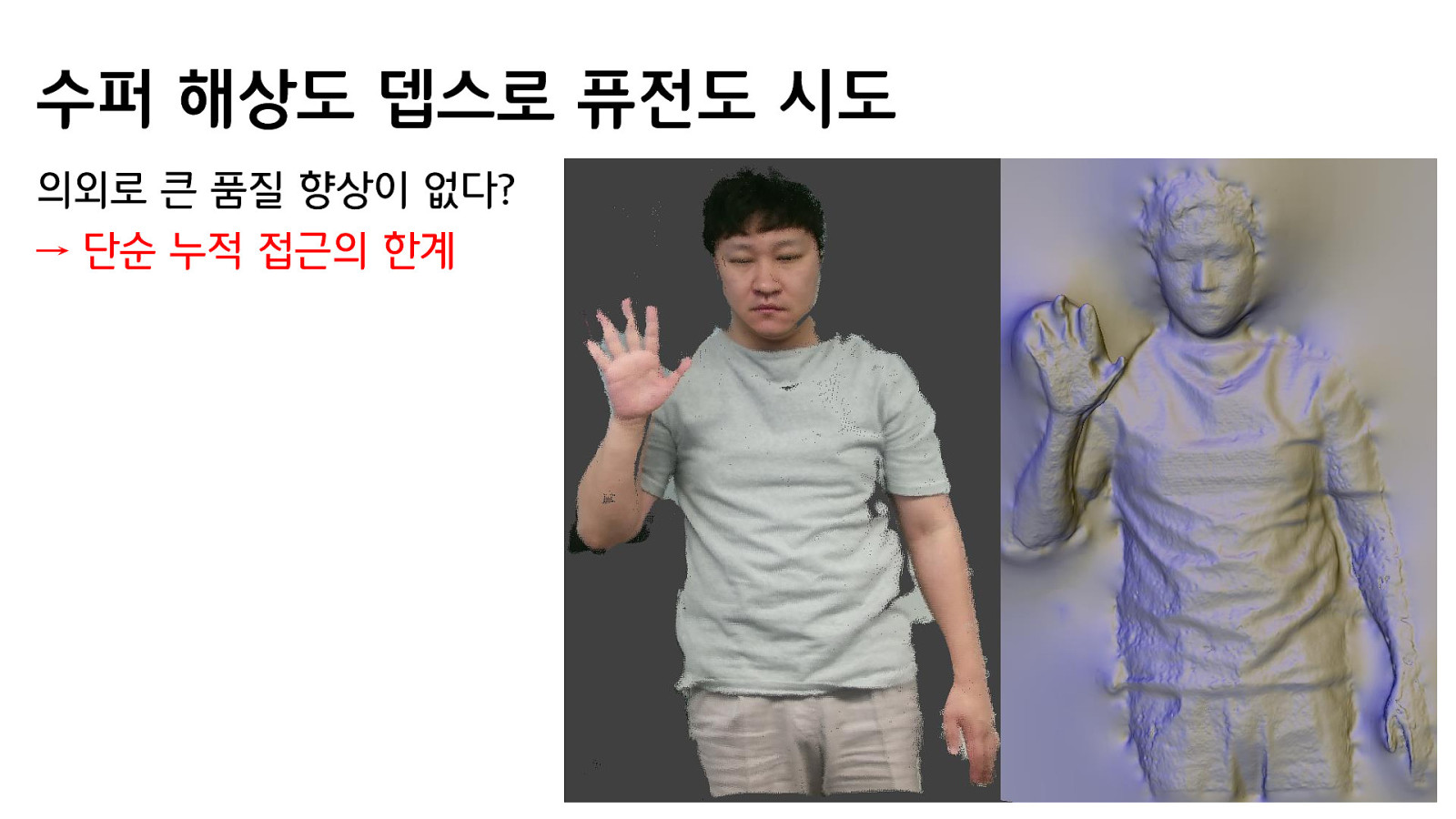

수퍼 해상도 뎁스로 퓨전도 시도 의외로 큰 품질 향상이 없다? → 단순 누적 접근의 한계

수퍼 해상도를 활용한 고품질 캡처 단계 평가 비교적 적절한 수준의 리소스 투여로 좋은 결과를 확보 특히 이미지 프로세싱 분야에 대한 지식을 많이 확보 하지만 최종 결과물의 품질 향상은 크지 않았음

3-c. TSDF 퓨전을 활용한 고품질 캡처 8월 9일~8월 25일 (출산휴가 제외 약 2주)

순간적인 깨달음 포인트 클라우드를 단순히 누적시키는 것으로는 품질 향상이 없다 기존에 구현했다가 기각한 TSDF가 노이즈를 저감하는 특성을 갖고 있다

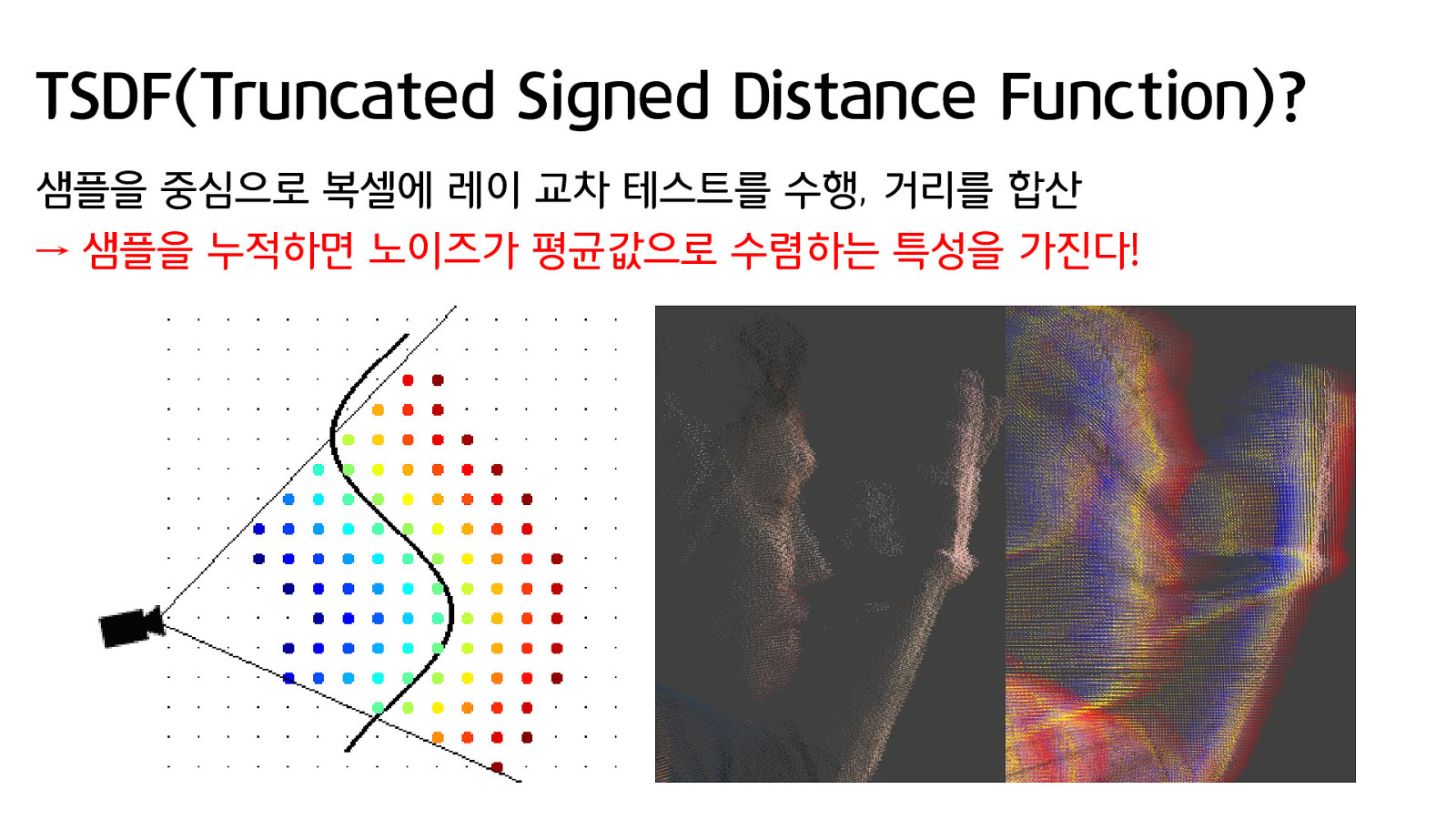

TSDF(Truncated Signed Distance Function)? 샘플을 중심으로 복셀에 레이 교차 테스트를 수행, 거리를 합산 → 샘플을 누적하면 노이즈가 평균값으로 수렴하는 특성을 가진다!

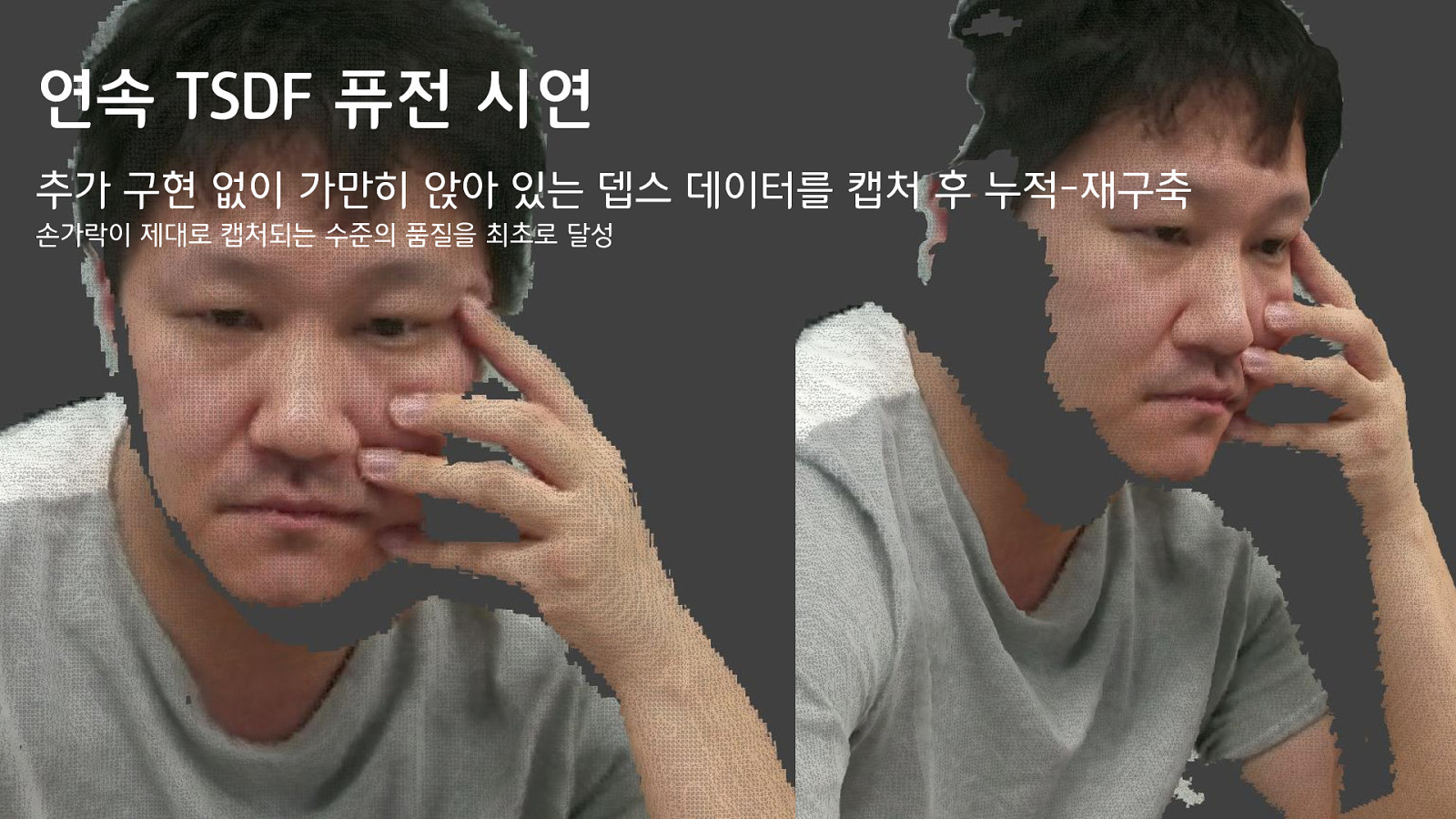

연속 TSDF 퓨전 시연 추가 구현 없이 가만히 앉아 있는 뎁스 데이터를 캡처 후 누적-재구축 손가락이 제대로 캡처되는 수준의 품질을 최초로 달성

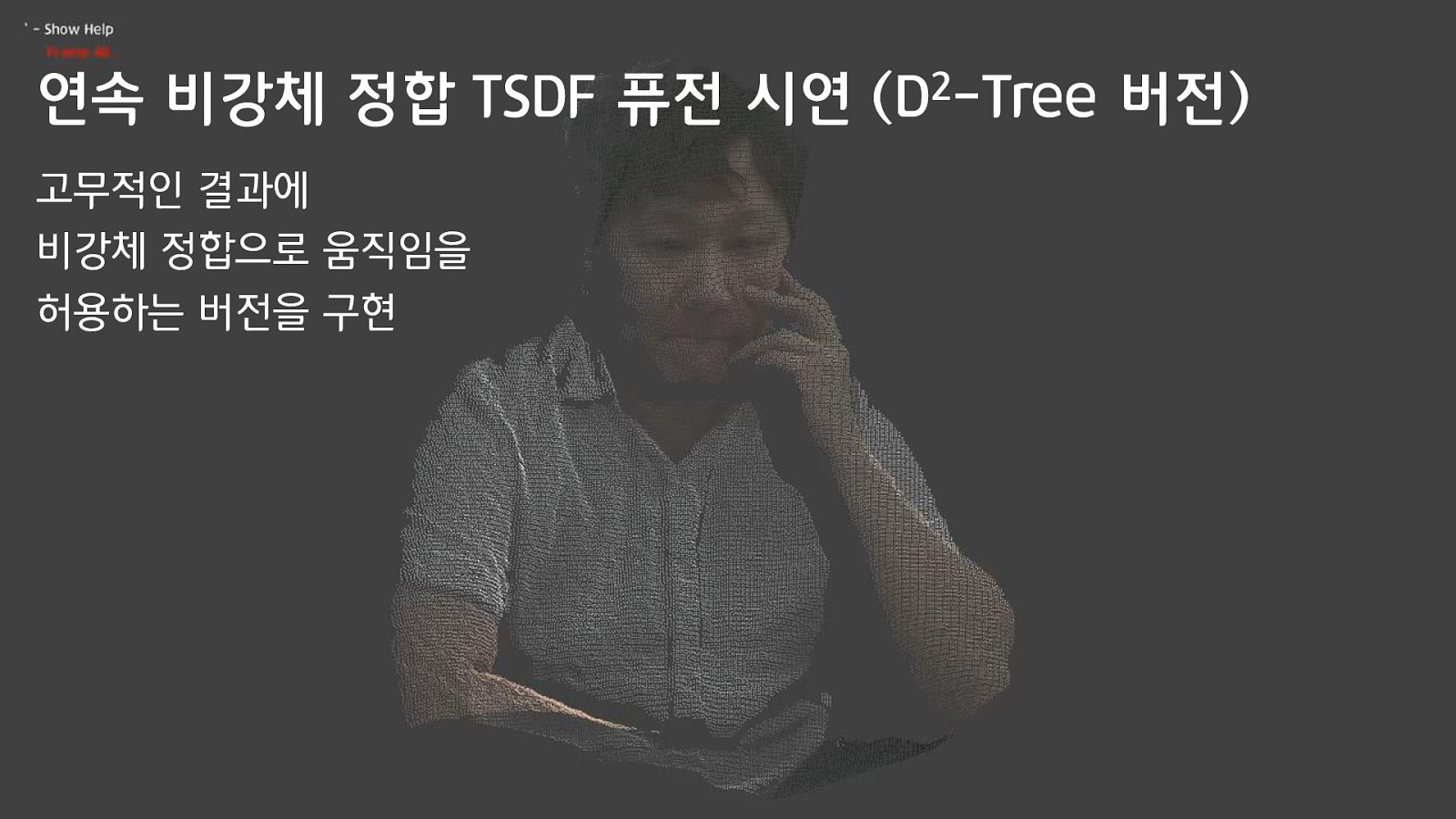

연속 비강체 정합 TSDF 퓨전 시연 (D2-Tree 버전) 고무적인 결과에 비강체 정합으로 움직임을 허용하는 버전을 구현

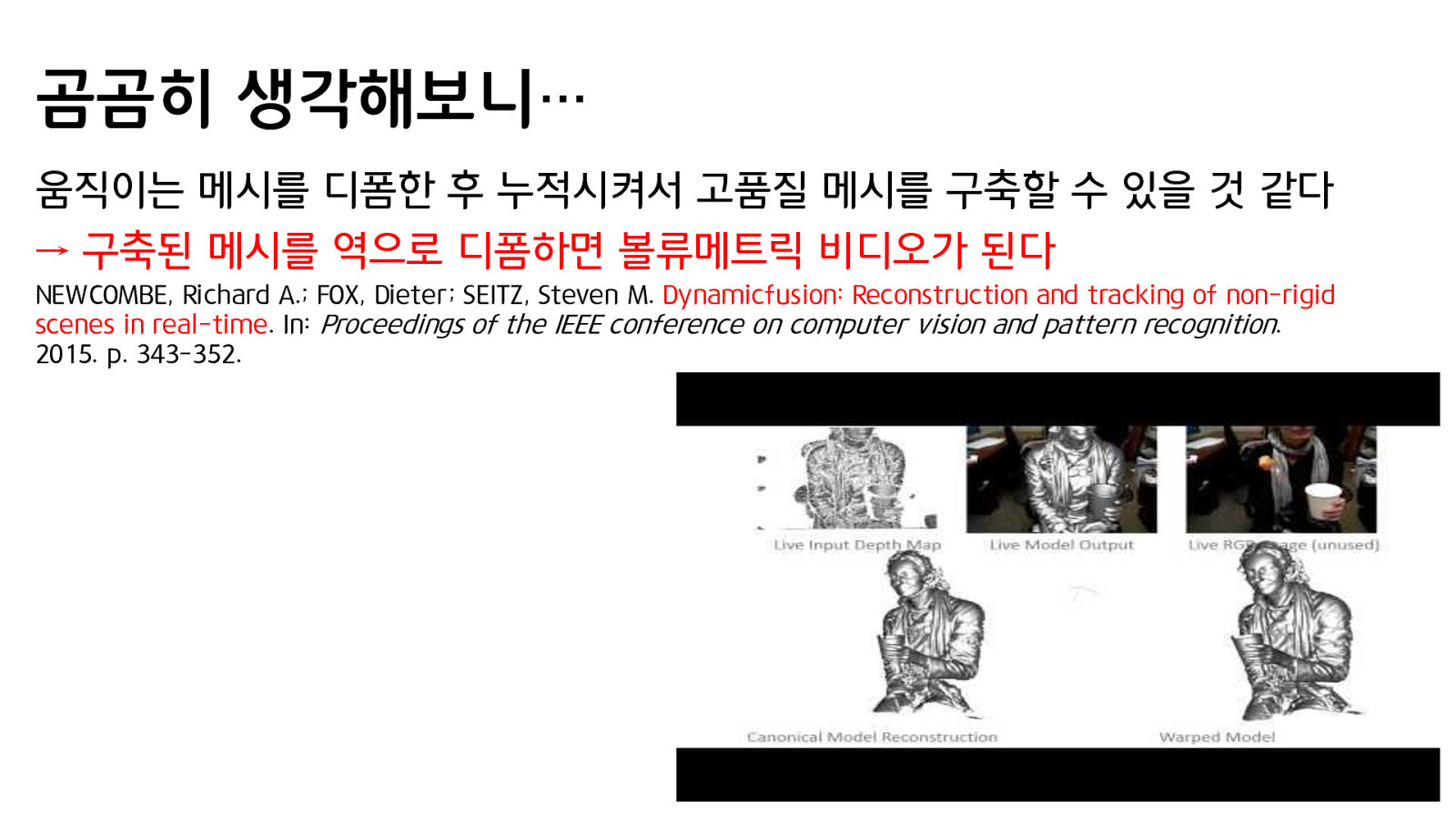

곰곰히 생각해보니… 움직이는 메시를 디폼한 후 누적시켜서 고품질 메시를 구축할 수 있을 것 같다 → 구축된 메시를 역으로 디폼하면 볼류메트릭 비디오가 된다 NEWCOMBE, Richard A.; FOX, Dieter; SEITZ, Steven M. Dynamicfusion: Reconstruction and tracking of non-rigid scenes in real-time. In: Proceedings of the IEEE conference on computer vision and pattern recognition. 2015. p. 343-352.

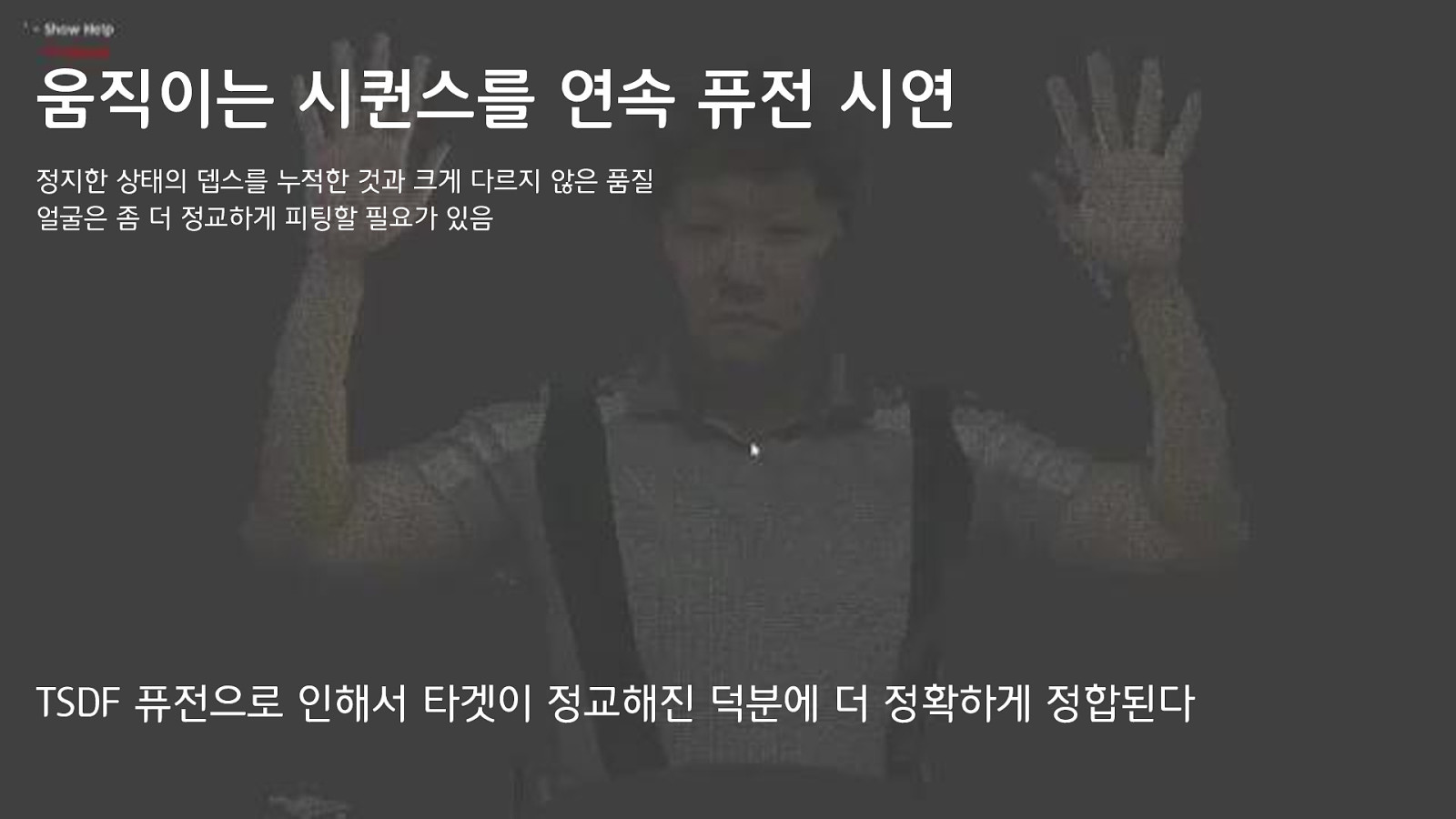

움직이는 시퀀스를 연속 퓨전 시연 정지한 상태의 뎁스를 누적한 것과 크게 다르지 않은 품질 얼굴은 좀 더 정교하게 피팅할 필요가 있음 TSDF 퓨전으로 인해서 타겟이 정교해진 덕분에 더 정확하게 정합된다

TSDF 퓨전을 활용한 고품질 캡처 단계의 평가 고품질 메시를 1대의 Kinect v2로 재구성할 수 있는 가능성을 확인 그간의 연구가 결실을 맺음 기존보다 훨씬 품질 좋은 볼류메트릭 비디오도 생성 가능 최적화가 아주 많이 필요함 (5초 처리에 1시간)

결론 및 추후 과제

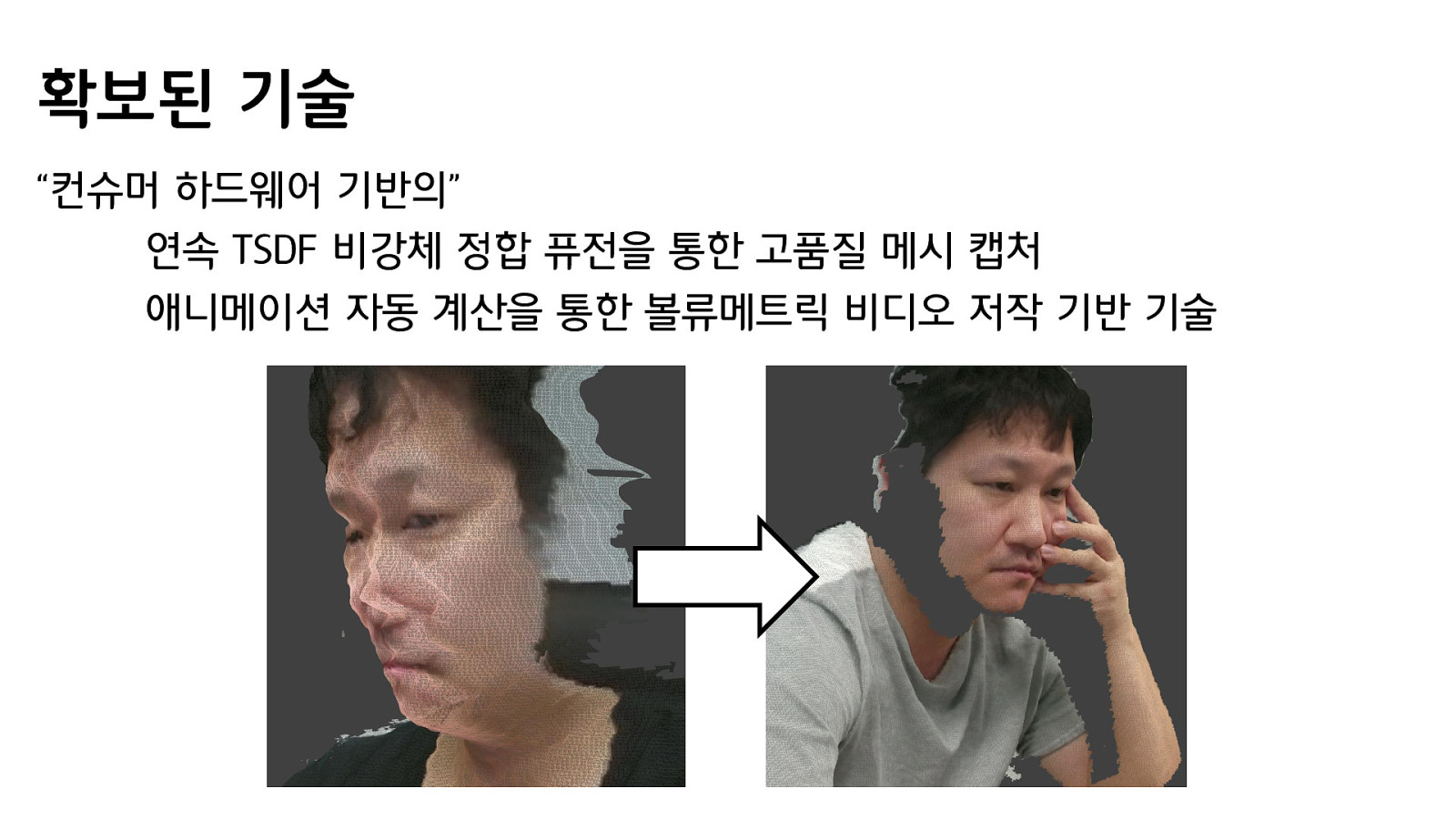

확보된 기술 “컨슈머 하드웨어 기반의” 연속 TSDF 비강체 정합 퓨전을 통한 고품질 메시 캡처 애니메이션 자동 계산을 통한 볼류메트릭 비디오 저작 기반 기술

기술 세부 수학 선형 최적화 기법 (곡면 근사, 뎁스맵 업샘플링을 비롯한 이미지 프로세싱) 레벤버그-마큇 비선형 최적화 기법 (Levenberg-Marquart) 멀티 스레딩 아이코날 방정식 (Eikonal Equation) 솔버 볼류메트릭 비디오 디포메이션 그래프를 이용한 임의의 형태의 디폼 D2Tree와 D2Tree를 활용한 비강체 정합 절단된 부호 거리 함수 (Truncated Signed Distance Function)을 활용한 메시 재구축 AR 업샘플링과 SD 업샘플링을 활용한 뎁스맵 수퍼 샘플링 엔지니어링 Freenect2를 활용, 다수의 키넥트를 이용하는 뎁스 캡처 KINSOL을 활용, Kinect에서 제공하지 않는 뎁스-카메라-컬러 스페이스 간의 좌표 변환 윈도우 미디어 라이브러리를 활용한 H.264 동영상 인코딩 DirectX 메시 라이브러리를 활용한 메시 리덕션

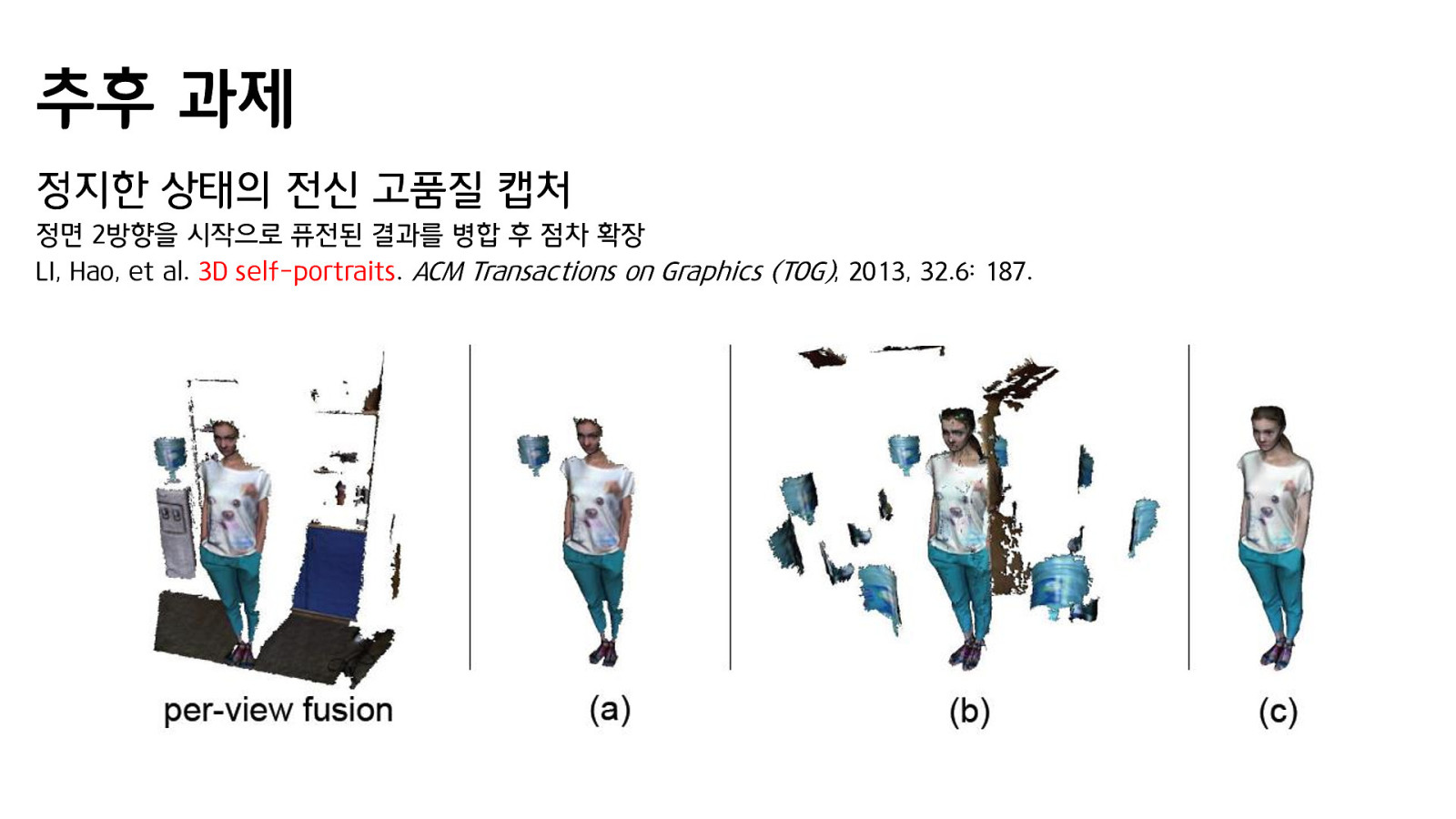

추후 과제 정지한 상태의 전신 고품질 캡처 정면 2방향을 시작으로 퓨전된 결과를 병합 후 점차 확장 LI, Hao, et al. 3D self-portraits. ACM Transactions on Graphics (TOG), 2013, 32.6: 187.

각 시점에서 최적의 텍스처 샘플링을 통해 텍스처링 GAL, Ran, et al. Seamless montage for texturing models. In: Computer Graphics Forum. Blackwell Publishing Ltd, 2010. p. 479-486.

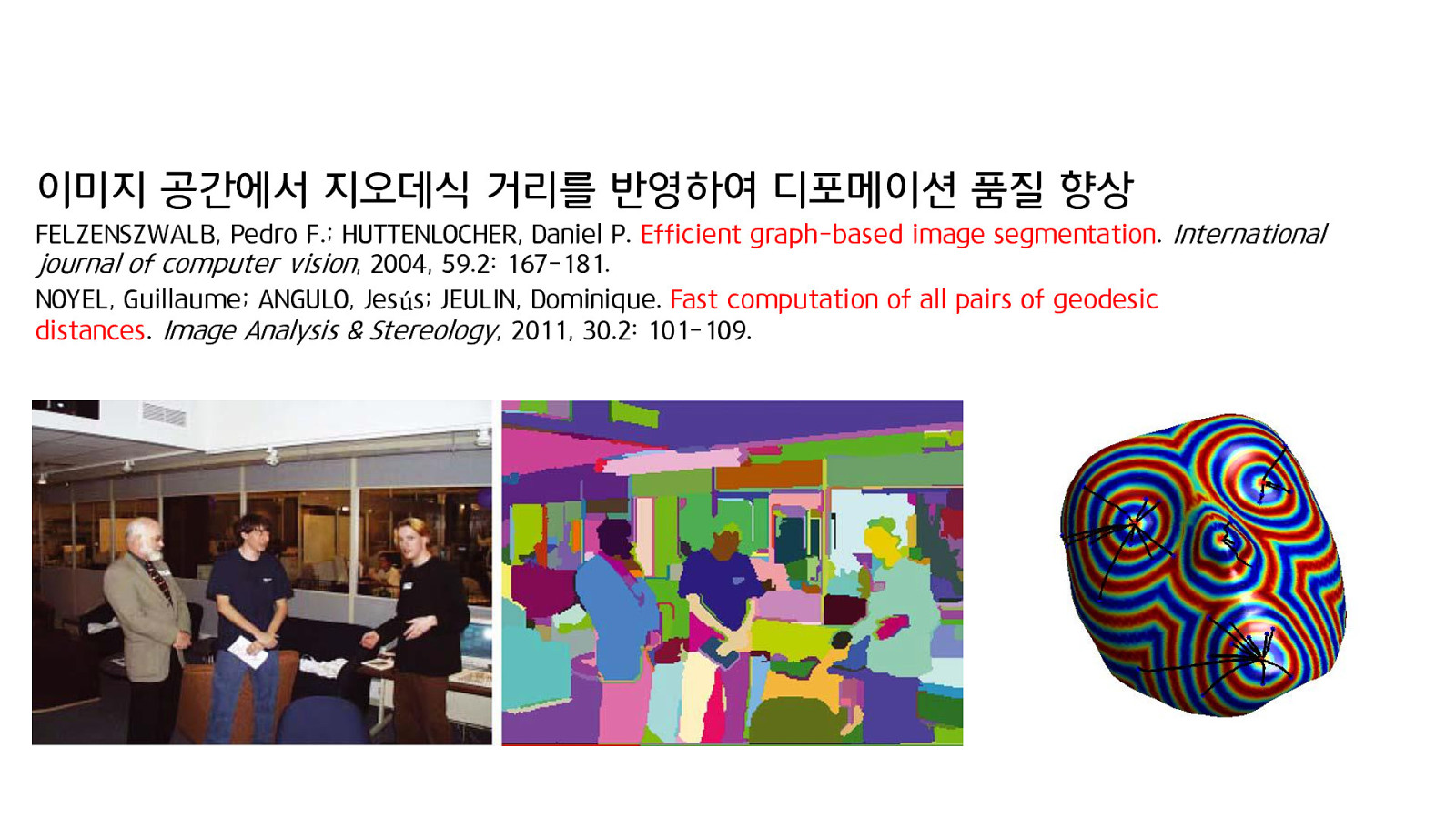

이미지 공간에서 지오데식 거리를 반영하여 디포메이션 품질 향상 FELZENSZWALB, Pedro F.; HUTTENLOCHER, Daniel P. Efficient graph-based image segmentation. International journal of computer vision, 2004, 59.2: 167-181. NOYEL, Guillaume; ANGULO, Jesús; JEULIN, Dominique. Fast computation of all pairs of geodesic distances. Image Analysis & Stereology, 2011, 30.2: 101-109.

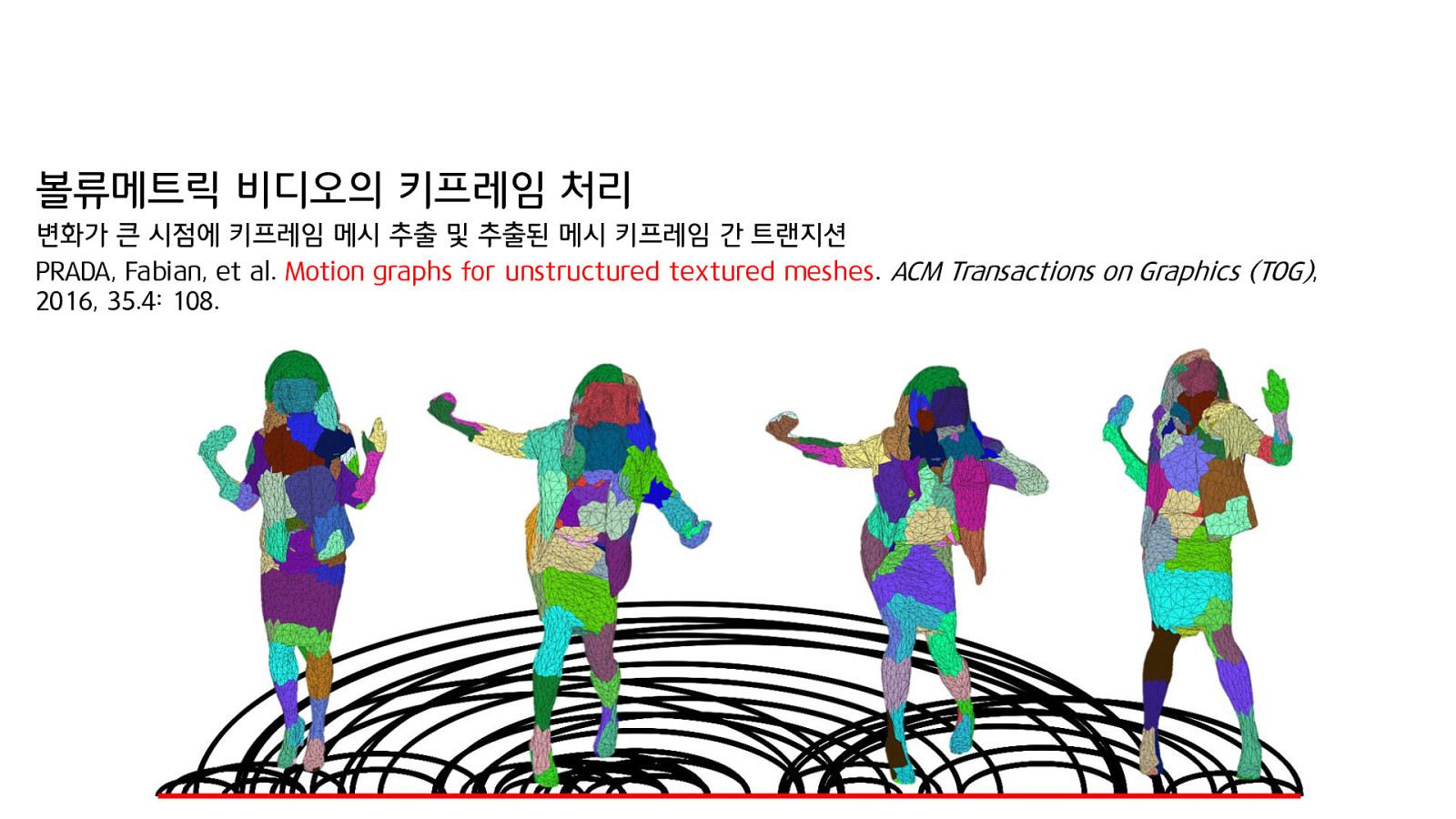

볼류메트릭 비디오의 키프레임 처리 변화가 큰 시점에 키프레임 메시 추출 및 추출된 메시 키프레임 간 트랜지션 PRADA, Fabian, et al. Motion graphs for unstructured textured meshes. ACM Transactions on Graphics (TOG), 2016, 35.4: 108.

고품질 템플릿 메시를 애니메이션에 맞춰 자동 스키닝 BOGO, Federica, et al. Detailed full-body reconstructions of moving people from monocular RGB-D sequences. In: Proceedings of the IEEE International Conference on Computer Vision. 2015. p. 2300-2308.

성능 향상 GPU 혹은 클라우드 컴퓨팅을 활용할 방안 강구

레퍼런스

Calibration XIANG, Wei, et al. A review and quantitative comparison of methods for kinect calibration. In: Proceedings of the 2nd international Workshop on Sensor-based Activity Recognition and Interaction. ACM, 2015. p. 3. RAPOSO, Carolina; BARRETO, Joao Pedro; NUNES, Urbano. Fast and accurate calibration of a kinect sensor. In: 3DTV-Conference, 2013 International Conference on. IEEE, 2013. p. 342-349. HERRERA, Daniel; KANNALA, Juho; HEIKKILÄ , Janne. Joint depth and color camera calibration with distortion correction. IEEE Transactions on Pattern Analysis and Machine Intelligence, 2012, 34.10: 2058-2064.

Depth Image Hole Filling and Super Sampling LIU, Soulan; CHEN, Chen; KEHTARNAVAZ, Nasser. A computationally efficient denoising and holefilling method for depth image enhancement. In: Real-Time Image and Video Processing. 2016. p. 98970V. WANG, Shenlong. A Tutorial on Primal-Dual Algorithm. 2016. YANG, Jingyu, et al. Color-guided depth recovery from RGB-D data using an adaptive autoregressive model. IEEE transactions on image processing, 2014, 23.8: 3443-3458. SCHROEDER, Jonatan; GUEDES, A. L. P.; DUARTE JR, Elias P. Computing the minimum cut and maximum flow of undirected graphs. RelatórioTécnico RT-DINF 003/2004, 2004. GRIGORESCU, Cosmin; PETKOV, Nicolai; WESTENBERG, Michel A. Contour detection based on nonclassical receptive field inhibition. IEEE Transactions on Image Processing, 2003, 12.7: 729-739. GREIG, Dorothy M.; PORTEOUS, Bruce T.; SEHEULT, Allan H. Exact maximum a posteriori estimation for binary images. Journal of the Royal Statistical Society. Series B (Methodological), 1989, 271279. BOYKOV, Yuri; VEKSLER, Olga; ZABIH, Ramin. Fast approximate energy minimization via graph cuts. IEEE Transactions on pattern analysis and machine intelligence, 2001, 23.11: 1222-1239.

BARNES, Randal J. Matrix differentiation. Department of Civil Engineering, University of Minnesota, 2014. FORD, Lester R.; FULKERSON, Delbert R. Maximal flow through a network. Canadian journal of Mathematics, 1956, 8.3: 399-404. RUDIN, Leonid I.; OSHER, Stanley; FATEMI, Emad. Nonlinear total variation based noise removal algorithms. Physica D: Nonlinear Phenomena, 1992, 60.1-4: 259-268. BOOKSTEIN, Fred L.. . Principal warps: Thin-plate splines and the decomposition of deformations. IEEE Transactions on pattern analysis and machine intelligence, 1989, 11.6: 567-585. MORDVINTSEV, Alexander. ROF and TV-L1 denoising with primal-dual algorithm. 2013 HAM, Bumsub; CHO, Minsu; PONCE, Jean. Robust image filtering using joint static and dynamic guidance. In: Proceedings of the IEEE Conference on Computer Vision and Pattern Recognition. 2015. p. 4823-4831. EBERLY, David. Thin plate splines. Geometric Tools Inc, 2002, 2002: 116. BREDIES, Kristian; KUNISCH, Karl; POCK, Thomas. Total generalized variation. SIAM Journal on Imaging Sciences, 2010, 3.3: 492-526.

Volumetric Video DOU, Mingsong, et al. Fusion4d: Real-time performance capture of challenging scenes. ACM Transactions on Graphics (TOG), 2016, 35.4: 114. COLLET, Alvaro, et al. High-quality streamable free-viewpoint video. ACM Transactions on Graphics (TOG), 2015, 34.4: 69. PRADA, Fabián, et al. Motion graphs for unstructured textured meshes. ACM Transactions on Graphics (TOG), 2016, 35.4: 108.

Articulated Shape Reconstruction BARAN, Ilya; POPOVIĆ, Jovan. Automatic rigging and animation of 3d characters. In: ACM Transactions on Graphics (TOG). ACM, 2007. p. 72. HIRSHBERG, David A., et al. Coregistration: Simultaneous alignment and modeling of articulated 3D shape. In: European Conference on Computer Vision. Springer Berlin Heidelberg, 2012. p. 242-255. BOGO, Federica, et al. Detailed full-body reconstructions of moving people from monocular RGB-D sequences. In: Proceedings of the IEEE International Conference on Computer Vision. 2015. p. 2300-2308. ANGUELOV, Dragomir, et al. Recovering articulated object models from 3D range data. In: Proceedings of the 20th conference on Uncertainty in artificial intelligence. AUAI Press, 2004. p. 18-26. ANGUELOV, Dragomir, et al. SCAPE: shape completion and animation of people. In: ACM Transactions on Graphics (TOG). ACM, 2005. p. 408-416.

Non-Rigid Registration and Fusion LI, Hao, et al. 3D self-portraits. ACM Transactions on Graphics (TOG), 2013, 32.6: 187. NEWCOMBE, Richard A.; FOX, Dieter; SEITZ, Steven M. Dynamicfusion: Reconstruction and tracking of non-rigid scenes in real-time. In: Proceedings of the IEEE conference on computer vision and pattern recognition. 2015. p. 343-352. WEISE, Thibaut, et al. Face/off: Live facial puppetry. In: Proceedings of the 2009 ACM SIGGRAPH/Eurographics Symposium on Computer animation. ACM, 2009. p. 7-16. LI, Hao; SUMNER, Robert W.; PAULY, Mark. Global Correspondence Optimization for Non‐Rigid Registration of Depth Scans. In: Computer graphics forum. Blackwell Publishing Ltd, 2008. p. 1421-1430. NEWCOMBE, Richard A., et al. KinectFusion: Real-time dense surface mapping and tracking. In: Mixed and augmented reality (ISMAR), 2011 10th IEEE international symposium on. IEEE, 2011. p. 127-136. Nurit Schwabsky, and Vered Cohen; Project Report, 2013 TAM, Gary KL, et al. Registration of 3D point clouds and meshes: a survey from rigid to nonrigid. IEEE transactions on visualization and computer graphics, 2013, 19.7: 1199-1217. LI, Hao, et al. Robust single-view geometry and motion reconstruction. In: ACM Transactions on Graphics (TOG). ACM, 2009. p. 175. INNMANN, Matthias, et al. Volumedeform: Real-time volumetric non-rigid reconstruction. In: European Conference on Computer Vision. Springer International Publishing, 2016. p. 362-379.

Reconstruction KEHL, Wadim, et al. An Octree-Based Approach towards Efficient Variational Range Data Fusion. arXiv preprint arXiv:1608.07411, 2016. CURLESS, Brian; LEVOY, Marc. A volumetric method for building complex models from range images. In: Proceedings of the 23rd annual conference on Computer graphics and interactive techniques. ACM, 1996. p. 303-312. DAVIS, James, et al. Filling holes in complex surfaces using volumetric diffusion. In: 3D Data Processing Visualization and Transmission, 2002. Proceedings. First International Symposium on. IEEE, 2002. p. 428-441. ZHAO, Mengyao, et al. High-quality Kinect depth filtering for realtime 3D telepresence. In: Multimedia and Expo (ICME), 2013 IEEE International Conference on. IEEE, 2013. p. 1-6.

Squared Distance VANCO, Marek. A direct approach for the segmentation of unorganized points and recognition of simple algebraic surfaces. 2002. GOLDMAN, Ron. Curvature formulas for implicit curves and surfaces. Computer Aided Geometric Design, 2005, 22.7: 632-658. EBERLY, David. Distance between point and triangle in 3D. Magic Software, http://www. magicsoftware.com/Documentation/pt3tri3. pdf, 1999. POTTMANN, Helmut; HOFER, Michael. Geometry of the squared distance function to curves and surfaces. In: Visualization and mathematics III. Springer Berlin Heidelberg, 2003. p. 221-242. CHE, Wujun; PAUL, Jean-Claude; ZHANG, Xiaopeng. Lines of curvature and umbilical points for implicit surfaces. Computer Aided Geometric Design, 2007, 24.7: 395-409. NURUNNABI, Abdul; WEST, Geoff; BELTON, David. Outlier detection and robust normal-curvature estimation in mobile laser scanning 3D point cloud data. Pattern Recognition, 2015, 48.4: 1404-1419. KLASING, Klaas, et al. Comparison of surface normal estimation methods for range sensing applications. In: Robotics and Automation, 2009. ICRA’09. IEEE International Conference on. IEEE, 2009. p. 3206-3211. MITRA, Niloy J., et al. Registration of point cloud data from a geometric optimization perspective. In: Proceedings of the 2004 Eurographics/ACM SIGGRAPH symposium on Geometry processing. ACM, 2004. p. 2231. LEOPOLDSEDER, Stefan; POTTMANN, Helmut; ZHAO, H. The d2-tree: A hierarchical representation of the squared distance function. Technical Report 101, 2003.

Eikonal Equation ZHAO, Hongkai. A fast sweeping method for eikonal equations. Mathematics of computation, 2005, 74.250: 603-627. DETRIXHE, Miles; GIBOU, Frédéric; MIN, Chohong. A parallel fast sweeping method for the eikonal equation. Journal of Computational Physics, 2013, 237: 46-55. CHACON, Adam; VLADIMIRSKY, Alexander. A parallel two-scale method for eikonal equations. SIAM Journal on Scientific Computing, 2015, 37.1: A156A180. CHACON, Adam; VLADIMIRSKY, Alexander. Fast two-scale methods for eikonal equations. SIAM Journal on Scientific Computing, 2012, 34.2: A547A578. BAK, Stanley; MCLAUGHLIN, Joyce; RENZI, Daniel. Some improvements for the fast sweeping method. SIAM Journal on Scientific Computing, 2010, 32.5: 2853-2874.

Fitting & Optimization NEALEN, Andrew; DARMSTADT, T. An as-short-as-possible introduction to the least squares, weighted least squares and moving least squares methods for scattered data approximation and interpolation. URL: http://www. nealen. com/projects, 2004, 130.150: 25. LOURAKIS, Manolis IA. A brief description of the Levenberg-Marquardt algorithm implemented by levmar. Foundation of Research and Technology, 2005, 4.1. EBERLY, David. Least squares fitting of data. Chapel Hill, NC: Magic Software, 2000. MADSEN, Kaj; NIELSEN, Hans Bruun; TINGLEFF, Ole. Methods for non-linear least squares problems. 1999. Denmarks Tekniske Universitet; Overhead of ‘02610 Optimization and Data Fitting’ CROEZE, ALFONSO; PITTMAN, LINDSEY; REYNOLDS, WINNIE. Solving nonlinear leastsquares problems with the Gauss-Newton and Levenberg-Marquardt methods. 2012.

끝